Siamese 네트워크 기반 SAR 표적영상 간 유사도 분석

Similarity Analysis Between SAR Target Images Based on Siamese Network

Article information

Trans Abstract

Different from the field of electro-optical(EO) image analysis, there has been less interest in similarity metrics between synthetic aperture radar(SAR) target images. A reliable and objective similarity analysis for SAR target images is expected to enable the verification of the SAR measurement process or provide the guidelines of target CAD modeling that can be used for simulating realistic SAR target images. For this purpose, this paper presents a similarity analysis method based on the siamese network that quantifies the subjective assessment through the distance learning of similar and dissimilar SAR target image pairs. The proposed method is applied to MSTAR SAR target images of slightly different depression angles and the resultant metrics are compared and analyzed with qualitative evaluation. Since the image similarity is somewhat related to recognition performance, the capacity of the proposed method for target recognition is further checked experimentally with the confusion matrix.

1. 서 론

디지털 사진 등의 광학영상 연구 분야에서는 영상 자체의 특성분석 뿐만 아니라 두 영상 간의 유사도를 객관적인 수치로 산출하기 위한 연구가 수행된 바 있다. 기본적인 유사도 지표의 예시로서 영상 간의 상관계수(correlation coefficients)나 평균제곱오차(Mean Square Error, MSE)가 활용되었고, MSE에 신호의 최대 값 개념을 더한 피크신호 대 잡음비(Peak Signal-to-Noise Ratio, PSNR)[1]나, 광학영상의 색채, 질감 등의 여러 요소별로 분리하여 유사도를 산출하는 동시발생 행렬(co-occurrence matrix)[2], 그리고 구조적인 특징을 수용하는데 특화된 사람의 시각특성을 모사하고자 한 구조적 유사도(Structural Similarity, SSIM)[3] 등이 활용되었다. 이들은 모두 사람의 주관적인 유사도 평가에 ‘동기화’된, 객관적인 지표를 산출하는 데 그 목적이 있다. 그러나 광학영상과는 달리, 합성 개구면 레이더(Synthetic Aperture Radar, SAR) 영상 분야에서는 이러한 유사도 지표에 대한 연구사례가 매우 드물다.

현재까지의 SAR 영상 간 비교에 관한 연구는 크게 2가지 측면으로 나누어 생각할 수 있다. 먼저 거시적인 측면에서는 SAR 전체 영상(SAR scene)간 혹은 이종영상의 비교로서, 유사도 분석보다는 영상 간 정합과 변화탐지에 주로 연구의 초점이 맞추어져 있다[4–6]. 반면 미시적인 측면에서는 전체 SAR 영상의 극히 일부를 차지하고 있는 표적영상 간의 비교로서, 유사도 분석보다는 다수의 표적영상으로 구성된 데이터베이스를 기반으로 시험 영상을 올바르게 분류하는 표적 자동식별(Automatic Target Recognition, ATR)에 집중한다[7–8]. 이러한 연구들과는 별개로 SAR 표적영상 간 신뢰성 높은 유사도 분석이 수행될 경우 기대되는 효과는 다음과 같다.

① 동일한 표적에 대해 여러 회에 걸쳐 SAR 측정을 수행할 때, 표적영상 간 유사도 분석을 통해 측정 과정(예를 들면 SAR 센서의 매개변수 설정이나, 특정 입사각을 위한 측정 항공기 항로 및 고도의 설정)의 타당성을 검증할 수 있다.

② 실측 SAR 표적영상과 CAD 모델로부터 전자파 시뮬레이션으로 예측한 표적영상 간 유사도 분석을 통해 CAD 모델링 및 시뮬레이션 기법 보완을 위한 지침(guideline)을 얻을 수 있다.

③ 위 ②와 관련하여 궁극적으로는 실측영상과 유사한 예측영상을 생성함으로써, SAR 표적 자동식별을 위한 데이터베이스 구축에 활용할 수 있다.

본 논문에서는 Siamese 네트워크[9]를 기반으로 미시적 측면에서의 SAR 표적영상 간 유사도를 산출하는 기법을 다룬다. 이전에 발표된 SAR 표적영상 간 유사도 산출 사례로서 광학영상에 적용되던 SSIM이 활용된 바 있고[10], SAR 표적영상이 광학영상과는 달리 산란점에 의해 특성화된다는 점에 착안하여 산란점 유사도가 연구된 바도 있다[11]. 그러나 전자의 경우 SSIM이 SAR 표적영상에 대해서는 변별력이 떨어진다는 문제가 발견되었다. 후자의 경우 산란점 추출과정이나 유사도 산출과정에서 경험적으로 설정해야 하는 변수가 많고, 오로지 산란점에 의해서만 유사도를 결정한다는 한계가 있다. 이에 본 논문에서 제시하는 유사도 분석기법은 두 영상 간의 유사도 산출에 특화되어 있는 거리학습(distance learning) 기반의 딥러닝 네트워크인 Siamese 네트워크를 차용한다. 먼저 학습용 표적영상 집합에 대해 방위각(aspect angle) 별로 분류한다. 이로부터 동일한 방위각의 영상 쌍을 ‘similar pair’로 두고 다른 방위각을 갖는 영상 쌍을 ‘dissimilar pair’로 두어 Siamese 네트워크를 학습시킨다. 즉 SAR 표적영상 간 유사도 산출에 있어서 경험적인 변수를 배제하고, 오로지 네트워크가 학습한 SAR 표적영상 간의 유사성을 바탕으로 객관적인 유사도 수치를 산출하는 것이다. 학습된 Siamese 네트워크의 유사도 분석을 시험하기 위해 MSTAR 15도 및 17도의 내림각(depression angle)을 갖는 표적영상 간 유사도 지표를 산출하고, 정성적인 분석을 통해 산출된 지표의 타당성을 확인한다. 또한 SAR 표적영상 간의 유사도가 SAR 표적식별 성능에 연관되므로, 제안된 Siamese 네트워크 기반 유사도 지표를 상대비교에 의한 식별에 적용할 경우에 대해서도 실험적으로 확인한다.

2. Siamese 네트워크 구조 및 학습

SAR 영상 분야에 Siamese 네트워크가 활용된 사례를 살펴보면 주로 SAR 영상 간 정합이나 SAR 영상패치와 동일한 부분을 나타내는 전자광학 영상의 패치를 찾아내는 연구에 주로 활용되었다. 이들과는 달리 본 논문에서는 Siamese 네트워크에서 출력되는 두 입력 SAR 표적영상 간의 유사도 값을 산출하고 이로부터 유사도 분석을 수행한다.

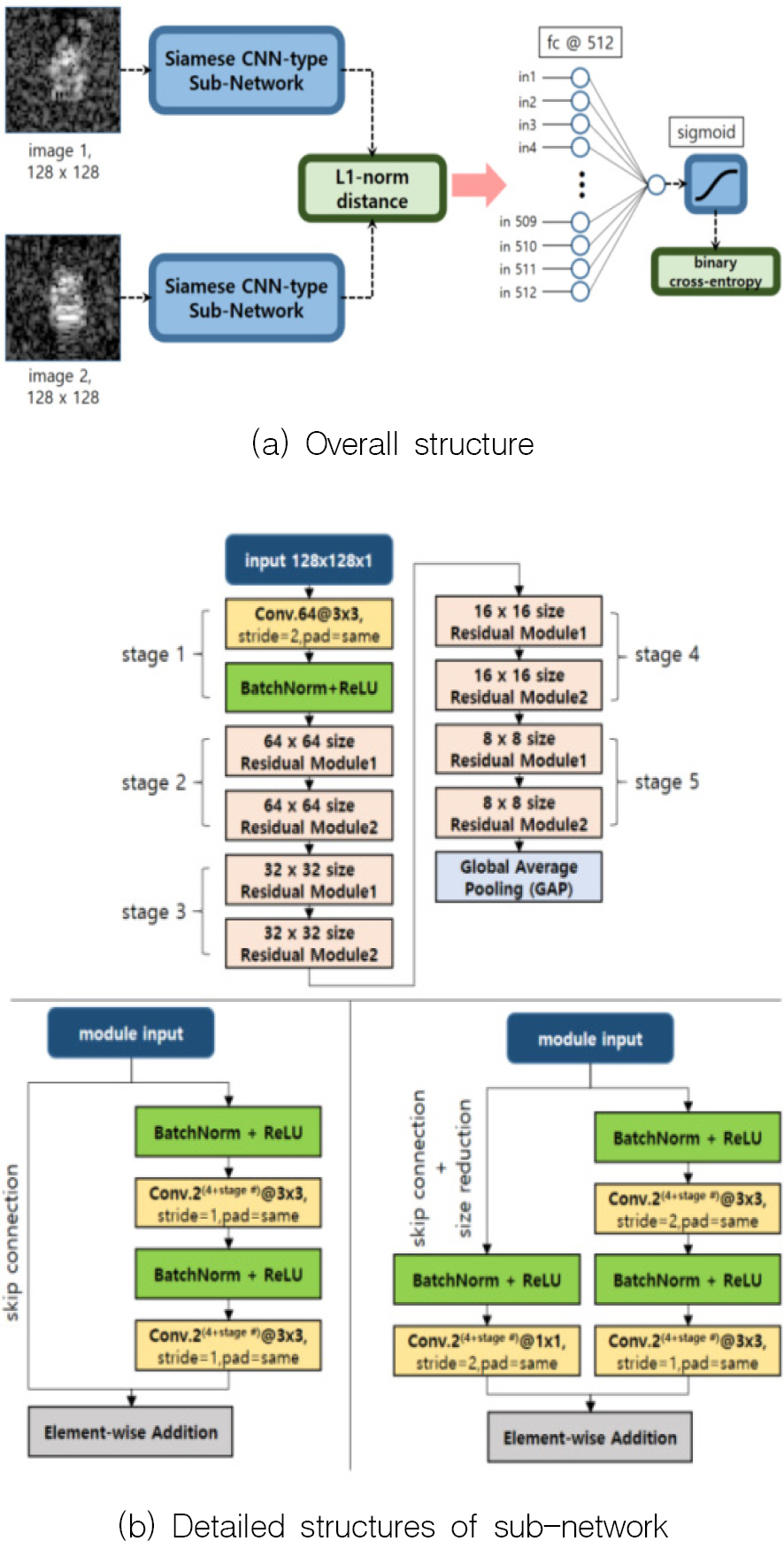

2.1 Siamese 네트워크 구조 및 기본특성

Fig. 1(a)에는 Siamese 네트워크의 전체 구조를 나타내었으며, 통상적인 합성곱 신경망(Convolutional Neural Network, CNN)과 달리 2개의 영상을 입력받아서 동일한 구조 및 가중치를 갖는 CNN(Sub-Network)에 각각 통과시킨다. Fig. 1(b) 위쪽에는 이러한 Sub-Network의 세부적인 구조를 나타내었으며, Koch[9]가 사용한 알렉스넷(Alexnet) 형태의 네트워크보다 진보된 레즈넷(ResNet)-18 형태의 네트워크를 사용하였다. 네트워크의 입력은 가로, 세로 크기가 128×128인 SAR 표적영상으로서, 원래 표적영상으로부터 표적 부분만 추출된 50×50 크기의 영상을 128×128 크기로 변경한 것이다. 크기 변경 시에는 최근접 내삽법(nearest interpolation)을 이용하여, 기존 표적영상 픽셀값의 변화를 최소화하였다. 이는 표적영상 간 유사도 학습에 가급적 배경 클러터 부분을 배제하고 표적 부분만 활용하기 위한 조치인데, 영역분할(segmentation)을 통해 표적영역 만을 고려하기에는 SAR 표적영상의 특성상 표적영역의 윤곽을 정확히 확정할 수 없다는 모호성이 존재한다. 이후 ‘stage 1’에서 3×3 convolution(conv) 및 배치 정규화(BatchNorm), ReLU 활성화를 거쳐서 64×64×64 크기의 특징맵(feature map)을 산출한다. ‘stage 2’에서도 동일한 크기의 특징맵에 대한 합성곱, 배치(batch) 정규화 등이 수행된다. 이후 ‘stage 3~5’에서는 특징맵의 가로×세로 크기가 1/2씩 줄어들면서 채널개수는 2배 증가한다. 이후 stage 5의 8×8×512 특징맵에 대해 Global Average Pooling(GAP)을 거쳐 채널수와 동일한 요소를 갖는 벡터가 형성됨으로써 입력영상이 1×512 크기의 특징벡터로 압축(encoding)된다. Fig. 1(b)의 좌측 하단은 ‘stage 2’의 모듈 및 ‘stage 3~5’의 두 번째 모듈(Residual Module)의 구조를 나타내고, 우측 하단은 ‘stage 3~5’의 첫 번째 모듈의 구조를 나타낸다. 여기서 stride는 합성곱 필터의 계산 보폭이며, ‘pad=same’은 합성곱 연산 결과 특징맵의 가로×세로 크기가 이전 크기의 1/stride 배가 되도록 입력 특징맵 둘레에 가변적으로 0을 위치(zero-padding)시킨다. 다시 Fig. 1(a)의 전체 구조로 돌아오면, Sub-Network 각각에서 도출된 특징벡터의 L1-norm 차이 벡터를 산출하고, 입력 뉴런 개수가 512이고 출력 뉴런개수가 1인 완전연결 계층(fully connected layer, fc)에 통과하여 도출된 스칼라 값에 시그모이드(sigmoid) 활성화 함수로 0~1 사이의 유사도 값을 출력하게 된다. 네트워크 학습 시에는 네트워크의 실제 출력과 기대값 사이의 이진 교차 엔트로피(binary cross-entropy) 손실을 산출하여 손실값을 역전파(back-propagation)시킨다. 이 때 기대값이란, 네트워크의 두 입력에 서로 비슷하다(similar)고 지정된 영상들이 들어갈 경우 1, 서로 다르다(dissimilar)고 지정된 영상들이 들어갈 경우 0에 해당한다. 이렇듯 Siamese 네트워크는 입력영상을 특정 부류(class)로 분류하는 특징을 학습하기보다는 입력된 두 영상 간의 거리 지표(distance metric) 기반 유사성을 학습하는데 적합하여 어떤 부류에 해당하는 영상이 매우 적은 경우 유용하게 활용할 수 있다. 이러한 특성으로 인해 Siamese 네트워크는 적은 샘플로 어떤 부류의 특징을 학습하는 ‘few-shot learning’의 목적을 궁극적으로 달성하기 위해 연구된 측면이 크다[9]. 본 논문에서는 동일한 구조 및 각도를 갖는 표적영상은 동일하게 형성된다는 전제 하에, L1-norm 기반 거리지표를 Siamese 네트워크 유사성 산출에 이용한다. 이는 L1-norm이 제곱연산이 수반되는 L2-norm에 비해 SAR 영상 내 스펙클(speckle)과 같은 아웃 라이어(outlier)에 덜 민감하기 때문에 영상의 중심에 위치한 표적 부분에 대한 학습에 네트워크 학습을 집중시키기 위함이다.

2.2 Siamese 네트워크 학습

Siamese 네트워크 학습에서 가장 중요한 요소는 영상 간의 유사성을 학습하기 위한 ‘similar’한 영상 쌍(pair)과 ‘dissimilar’한 영상 쌍을 지정하는 방법이다. Koch가 사용한 알파벳 글자(Omniglot dataset)간의 유사성을 판단하는 Siamese 네트워크의 경우, 필체가 다른 동일한 글자의 영상을 ‘similar’한 영상으로, 다른 글자의 영상을 ‘dissimilar’한 영상으로 지정하였다. 그러나 SAR 표적영상의 경우에는, ‘필체’와 같은 요소가 없으므로 다음의 여러 방안을 고려할 수 있다.

① 동일한 표적 및 동일한 획득조건(입사각, 해상도, 표적의 방위각 등)에 대해 동일 SAR 센서로 반복적으로 획득했거나, 다른 SAR 센서로 획득된 표적영상들을 ‘similar’한 영상으로 지정한다.

② 동일한 표적 및 획득조건(각도, 해상도 등)에 대해 다른 클러터 환경(아스팔트, 시멘트, 잔디, 모래 등과 같은 지면의 매질)에서 획득된 표적영상들을 ‘similar’한 영상으로 지정한다.

③ 단일 표적영상에 대해 픽셀 단위로 평행이동을 시키거나 잡음을 추가하는 등의 데이터 증대 기법을 차용하여 수량이 늘어난 표적영상들을 ‘similar’한 영상으로 지정한다.

위에서 언급된 3가지 방안 외에도 여러 가지 방안이 있을 수 있다. 다만 방안 ①이나 ②는 실제로 2개 이상의 SAR 센서를 운용하거나, 동일한 표적을 다양한 클러터 환경에 위치시켜 측정해야 하므로 시간/비용 측면에서 실현 가능성이 낮다. 따라서 본 논문에서의 Siamese 네트워크를 기반으로 한 SAR 표적영상 유사도 분석 시 네트워크 학습 방법은 방안 ③을 기본적으로 차용한다. 세부 방안은 다음과 같다.

① 본 논문은 SAR 표적영상 식별보다는 두 SAR 표적영상 간 유사도 산출에 집중하고 있으므로, 문제의 단순화를 위해 여러 종류의 표적 보다는 특정 표적 1종에 대한 Siamese 네트워크를 만든다.

② 두 개의 영상입력을 갖는 Siamese 네트워크를 학습시키기 위한 ‘similar’한 영상은 하나의 표적영상에 대해 픽셀 평행이동에 의한 데이터 증대(49배)를 수행한 후, 학습 진행 중에 임의로 2개를 쌍으로 지정한다. 이 때 세부적으로는 가로 및 세로방향으로 0, ±2, ±4, ±6픽셀을 이동시킴으로써 평행 이동에 대해 불변(translation-invariant)하도록 한다. 이는 늘어난 학습영상에 의해 네트워크의 학습을 강인하게 만들 뿐만 아니라, 네트워크가 유사도를 산출을 위해 학습되는 과정에서 영상에 위치한 표적 부분에 집중할 수 있는 효과를 볼 수 있다. ‘dissimilar’한 영상은 다른 방위각을 갖는 표적영상 쌍을 활용하며, T72(S/N : 132) 표적영상의 경우 방위각은 총 232가지이다.

③ ‘similar’ 또는 ‘dissimilar’의 2개 부류(2-class)에 대한 학습문제에서는 부류 간 샘플 수의 균형(class balance)이 중요하다. 따라서 본 논문에서는 네트워크 학습 시 50 %의 확률로 ‘similar’ 또는 ‘dissimilar’한 영상 쌍을 임의로(randomly) 선택하여 네트워크 학습의 기본단위인 미니배치(mini-batch)를 구성한다.

④ 미니배치는 64개의 영상 쌍으로 구성되며, ‘similar’와 ‘dissimilar’ 영상 쌍이 각각 절반의 비율을 차지한다. 또한 앞서 언급한 바와 같이 영상 쌍이 임의로 지정되는 만큼, 최대한 많은 미니배치 단위의 반복 학습을 수행한다. 본 논문에서 구성하는 Siamese 네트워크의 경우 반복 횟수 20,000회 전후에서 학습 데이터 셋에 대한 손실이 수렴하였다.

⑤ 네트워크 학습을 위한 솔버(solver)는 기울기 감쇄 요소(gradient decay factor)와 제곱 기울기 감쇄 요소(square gradient decay factor) 각각 0.9와 0.99를 갖는 ‘adam’ 최적화 기법을 사용하였다. 학습률(learning rate)은 6×10−5로 지정하였다.

3. Siamese 네트워크 기반 표적영상 유사도 분석

3.1 유사도 분석을 위한 SAR 표적영상의 준비

2장에서 기술한 Siamese 네트워크의 학습에 이용할 SAR 표적영상은 MSTAR 공개용 데이터 셋의 표적영상을 활용한다. 데이터 셋의 표적영상을 모두 활용하면 본 논문에서의 유사도 분석 범위가 광범위해지기 때문에, 앞서 언급한 바와 같이 센서 내림각 15도에서 획득한 T72(S/N : 132) 탱크 표적의 영상만을 이용하여 Siamese 네트워크를 학습시킨다. 여기서 ‘S/N’은 일련번호를 의미한다. 유사도를 분석할 때에는 Fig. 1(a)의 ‘image 1’에 학습에 이용한 T72(S/N : 132, 내림각 15도) 표적영상을 입력하고, ‘image 2’에 내림각 17도를 갖는 동종표적(T72, S/N:132)과 시리얼 번호가 다른 동종표적(T72, S/N:812) 그리고 이종 표적인 BMP2(보병 수송)와 BTR70(보병 전투) 등 총 4종의 표적영상을 비교대상으로 입력하여 ‘image 1’에 입력된 영상과의 유사도를 각각 산출한다. Fig. 2에는 본 논문에서 유사도 분석에 사용할 4종의 표적 및 각각에 해당하는 MSTAR SAR 표적영상의 예시를 나타내었다.

구체적인 유사도 분석의 방법은 다음과 같다.

① ‘image 1’에는 방위각(aspect angle) A와 내림각 15도를 갖는 T72(S/N : 132)표적의 영상을 입력한다.

② ‘image 2’에는 (A-5)도에서 (A+5도) 범위 내의 방위각을 갖는 비교대상 표적(내림각 17도)의 SAR 표적영상을 입력한다.

③ ‘image 2’에 입력된 영상 중 최대 유사도 값을 갖는 방위각의 영상을 ‘image 1’에 입력된 영상과 ‘image 2’에 입력된 영상 간의 유사도로 간주한다.

④ 예를 들어, ‘image 1’에는 내림각 15도/방위각 87도인 T72(S/N : 132) 표적영상을 입력하고, ‘image 2’에는 유사도 분석대상인 내림각 17도 BMP2 표적영상을 입력할 때, BMP2 표적영상의 방위각은 82도에서 92도 사이에 해당되어야 한다. 그에 해당되는 방위각이 83도, 85도, 87도, 89도, 91도의 5가지일 경우, 총 5번의 유사도를 산출하여 그 중 최대 유사도 값이 산출된 결과를 내림각 15도/방위각 87도 T72(S/N : 132) 표적영상과 내림각 17도인 BMP 표적영상 간의 최종 유사도로 정의한다.

⑤ 위와 마찬가지의 방식으로 내림각이 17도인 BTR70 표적영상과, 내림각이 17도인 T72(S/N : 132) 및 T72(S/N : 812)의 표적영상에 대해서도 수행함으로 써 ‘image 1’에 입력된 영상에 대해 총 4건의 유사 도를 산출한다. 산출된 유사도와 육안 관측 시 ‘유 사함’의 기준으로 삼는 것들(예를 들어 표적영상의 산란점 위치/표적영상의 모양)과 연관지어 정성적 인 분석을 수행하고, 이를 바탕으로 산출된 지표의 타당성을 확인한다.

⑥ 위 ①~⑤의 과정을 내림각 15도 T72(S/N : 132)표적의 다른 방위각 영상에 대해 반복한다.

여기서 내림각 15도인 T72(S/N : 132) 표적영상과 동일한 방위각을 부여하지 않고, 10도 범위의 여러 방위각 영상에 대해 유사도를 산출하는 것은 SAR 센서의 관측각인 내림각이 변화함에 따라 표적의 방위각이 동일해도 전자파의 산란특성이 작은 방위각의 범위 내에서도 달라질 수 있기 때문이다. 방위각의 범위를 위와 같이 한정한 이유는 2장에서 언급한 바와 같이, 서로 다른 방위각을 갖는 영상 간에는 ‘dissimilar’, 즉 0의 유사도를 산출하도록 Siamese 네트워크의 학습이 이루어지기 때문에, 방위각이 일정 값 이상 다른 표적영상 간에는 유사도 산출이 무의미하기 때문이다. 실제로 해당 방위각 범위 밖에서는 유의미한 유사도 값이 산출되지 않았다.

3.2 내림각 15도, T72(S/N:132) 영상과의 유사도 분석

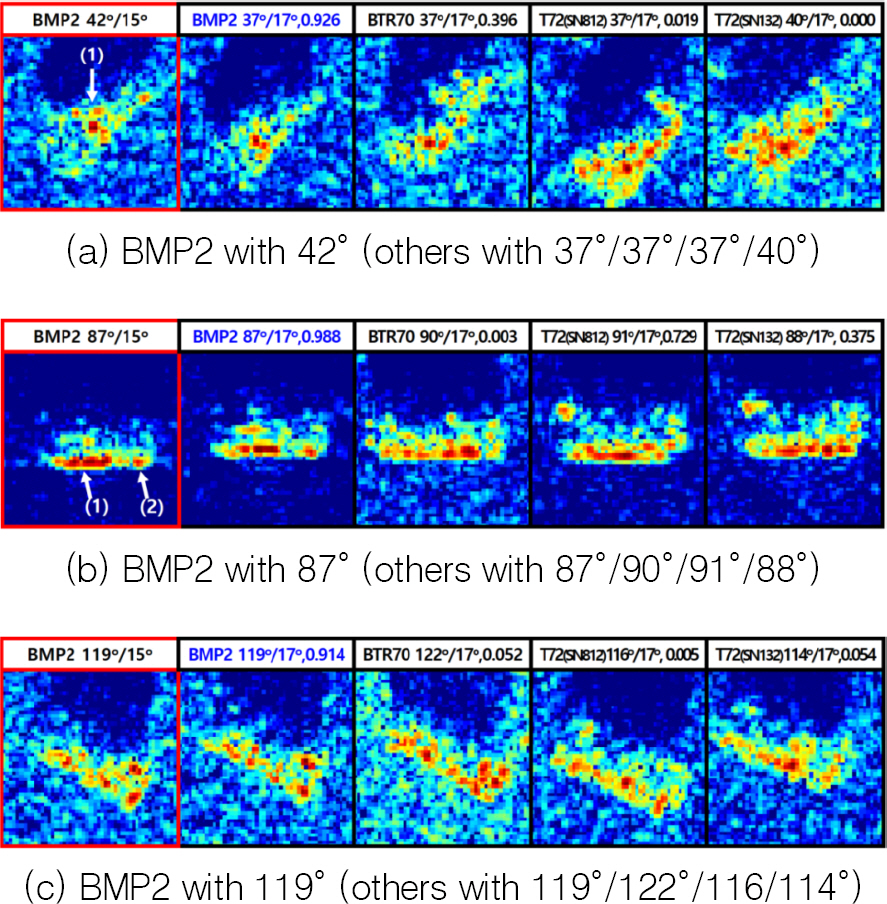

Fig. 3에는 내림각 15도인 T72(S/N : 132)표적영상의 방위각 별로 비교대상 표적 4종(내림각 17도) 각각에 대한 유사도 산출결과를 나타내었다. Fig. 3(a)을 보면, 맨 좌측에 ‘image 1’ 입력대상인 내림각 15도/방위각 26도인 T72(S/N : 132) 표적영상이 도시되어 있다. 표적영상의 위에는 ‘표적명(시리얼 번호)’ 및 ‘방위각/내림각’이 기재되어 있다. 우측의 4개의 영상은 ‘image 2’에 입력된 내림각 17도의 BMP2, BTR70, T72(S/N : 812), T72(S/N : 132) 표적영상을 순서대로 나타내며, 표적명과 방위각/내림각 및 산출된 유사도 값이 기재되어 있다. 이 때 방위각은 3.1절에서 언급한 바와 같이 ‘image 1’ 입력대상과 최대 유사도를 내는 ‘image 2’ 입력대상 영상의 방위각을 나타낸 것이다. Table 1에는 Fig. 3의 각 해석사례별로 기존 유사도 지표인 구조적 유사도(SSIM)와 본 논문에서 제시되는 Siamese 네트워크 유사도를 함께 나타내었다. ‘1~4’로 표시된 숫자는 각각 내림각 15도 T72(S/N : 132) 영상과, 내림각 17도의 BMP2, BTR70, T72(S/N : 812 및 132) 영상 간 유사도를 의미한다. SSIM와 함께 기존 지표인 NCC(Normlized Cross-Correlation, 정규화 교차 상관도)도 표시하였으며, 유사도 수치의 경향은 SSIM의 그것과 유사하다. 이제 각 방위각 별로 Fig. 3의 표적영상과 Table 1에 산출된 유사도 지표들로부터 정성적 분석을 수행한다.

① Fig. 3(a)에는 방위각 26도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. BMP2 표적영상과 BTR70 표적영상의 경우 육안으로 관측되는 바와 동일하게 0에 가까운 유사도를 보이며, T72 표적은 (S/N : 812)와 (S/N : 132)이 각각 0.930, 0.993의 높은 유사도를 보인다. 맨 좌측의 기준영상은 크게 후미(1)와 동체(2)로 구성되는데, 맨 우측의 동종 표적영상의 경우 이 부분에서 산란점의 분포 및 형태의 유사성이 높다. 시리얼 번호 812의 영상은 동체의 형태는 유사하나 산란점 분포에서 다소 차이가 발생하고, 특히 후미 부분은 Fig. 2에 나타난 바와 같이 연료통의 존재로 인하여 유사도가 상대적으로 낮아진다.

② Fig. 3(b)에는 방위각 54도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. BMP2와 BTR70 뿐만 아니라, T72(S/N : 812)의 표적영상도 유사성이 낮으며, 동일한 표적인 T72(S/N :132)의 경우 유사도 0.960이 산출되었다. 이는 전체적으로 표적 일부 산란점((1)로 표시)만 강하게 나타나고 전반적으로 표적 및 클러터 배경의 신호가 약하게 형성되는 경향이 유사하기 때문이다. 다만 표적의 형태 및 강한 산란점 (1)은 유사하나, (2)~(4) 부분에서 차이가 나타난다.

③ Fig. 3(c)에는 방위각 72도/내림각 15도인 T72(S/N : 132) 표적영상과의 유사도 산출결과를 나타내었다. 여기서는 Fig. 3(a)에서 분석된 바와 동일하며, 맨 우측의 동일표적/시리얼 번호의 표적영상이 0.985로 높은 유사도 값을 보이고, 우측에서 두 번째인 T72(S/N : 812)의 영상은 동체 부분의 산란점 분포 및 후미 부분(표적 영상의 우측)에서 차이가 발생하여 0.799의 유사도를 갖는다. BMP2 표적영상과의 유사도는 없는 것으로 산출되는데, Table 1의 SSIM에서는 오히려 T72(S/N : 812)의 SSIM(0.672)보다 높은 0.687을 갖는다. 그러나 표적의 좌측 면(흰 사선으로 표시)의 산란점 분포나 그 외 동체에서의 산란점 분포의 차이가 상당하므로 SSIM의 결과에는 신뢰성이 다소 떨어지며, 표적 4종의 SSIM 값 간에도 큰 차이가 없어 변별력이 낮다.

④ Fig. 3(d)에는 방위각 87도/내림각 15도인 T72(S/N : 132) 표적영상과의 유사도 산출결과를 나타내었다. 표적의 앞부분이 9시 방향을 향하고 있기 때문에 표적의 좌측 부분에 의한 반사특성이 유사도 산출에 미치는 영향이 크다. BTR70과 T72의 두 표적영상 모두 유사한 표적의 형태 및 좌측 부분의 반사특성에 의해 Siamese 네트워크 유사도가 0.98 이상으로 높다. 다만 좌측 상단에 위치한 산란점((1)로 표시)에 의해 T72 표적 둘의 유사도가 BTR70보다는 상대적으로 높다. 반면 Table 1의 SSIM의 경우, 외관상 표적 형태에서 큰 차이를 보이는 BMP2 표적영상에 대해서도 비교적 높은 0.677의 유사도가 산출되고, BTR70의 표적영상에서 가장 높은 0.740의 유사도가 산출되므로 Siamese 네트워크 유사도에 비해 낮은 유사도 평가 성능을 보인다.

⑤ Fig. 3(e)에는 방위각 110도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. 표적의 신호가 가장 좁게 나타나는 BMP2 표적영상의 경우 낮은 유사도(0.176)를 보이고, 길이와 형태면에서 다른 BTR70 표적영상 또한 낮은 유사도(0.300)를 보인다. 동일한 T72의 표적영상 둘의 경우 0.963, 0.972의 높은 유사도를 보이는데, 전반적인 표적형태와 동체의 산란점, 특히 (1)로 표시한 산란점의 유사성이 높다.

⑥ Fig. 3(f)에는 방위각 143도/내림각 15도인 T72(S/N : 132) 표적영상과의 유사도 산출결과를 나타내었다. BMP2 표적영상의 경우, 산란점의 분포는 상이하지만 표적형태의 유사성으로 비교적 높은 유사도 (0.609)가 산출된다. 반면 BTR70 표적영상은 표적의 후미(우측 하단)와 좌측면에만 산란점이 형성되어 유사성이 낮음을 알 수 있다. T72(S/N : 812) 표적영상의 경우, 후미 부분의 굴곡에 의한 차이가 발생하고, (1)로 표시한 강한 산란점의 위치가 다소 다르다. T72(S/N : 132) 표적영상은 표적 형태가 보다 유사하지만 강한 산란점 (1) 및 산란점 (2)의 세기가 달라 0.9 이하의 유사도를 보인다. Table 1의 SSIM은 전반적으로 값의 차이가 적어 변별력이 떨어지며, 특히 BTR70 표적영상과의 유사도가 0.662로 높게 산출된다.

⑦ Fig. 3(g)에는 방위각 161도/내림각 15도인 T72(S/N : 132) 표적영상과의 유사도 산출결과를 나타내었다. 이 방위각에서는 표적의 후미 부분(표적영상의 하단)이 SAR 입사신호의 전면에 위치하기 시작하는 각도이다. BMP2 및 BTR70 표적영상은 육안 관측상으로도 유사성이 낮다. T72(S/N : 812)의 경우 후미에 위치한 연료통의 반사특성으로 인해 표적형태의 차이가 발생함에 따라 낮은 유사도(0.339)를 보인다. T72(S/N : 132)의 경우 유사도가 상대적으로 높지만 0.9 이하의 값을 나타내는데, 내림각의 차이에 의해 후미 부분이 보다 넓게 형성됨에 따른 것으로 분석된다.

⑧ Fig. 3(h)에는 방위각 180도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. 이 방위각에서는 표적의 앞부분이 12시 방향을 향하여 표적 후미 부분에 의한 영향이 높아진다. BMP2와 BTR70 표적영상은 육안으로 관측되는 바와 동일하게 0의 유사도를 보이며, T72(S/N : 812)의 경우 후미 연료통의 반사특성으로 인해 유사성이 거의 없는 것으로 산출된다. T72(S/N : 132) 표적영상은 형태 자체는 상당히 유사하지만, (1)과 (2) 부분을 구성하는 강한 산란점의 분포가 상이하여 0.746의 유사도를 갖는다. 특히 (1) 부분에서는 맨 좌측 영상이 4개의 큰 산란점을 명확히 가지는데 비해, 맨 우측 영상에서는 이를 관측하기 어렵다. Table 1의 SSIM에서는 육안 관측결과와는 달리 BTR70의 영상 유사도가 0.818로 매우 높으며, BMP2 영상의 유사도도 0.732로 높다.

⑨ Fig. 3(i)에는 방위각 195도/내림각 15도인 T72(S/N : 132) 표적영상과의 유사도 산출결과를 나타내었다. BMP2 및 BTR70 표적영상은 외형상 유사성이 없어 수치상으로도 0에 가까운 유사도가 산출된다. T72(S/N : 812) 영상의 경우, 동일한 T72 표적임에도 불구하고, 후미 부분(영상의 아래쪽)의 형태와 표적영상에 나타난 표적 길이 자체가 다르기 때문에 0.113이라는 낮은 유사도가 산출되었다. T72 (S/N : 132) 영상은 상대적으로 높지만 0.9보다 낮은 0.880의 유사도를 나타내는데, (1)~(3)로 표시한 주요 산란점의 세기 및 위치가 다소 다른 결과를 반영한 것으로 분석된다. 반면 Table 1에 나타낸 SSIM 값의 경우, T72 표적의 두 영상 간의 수치가 각각 0.723, 0.747로 상당히 높을 뿐만 아니라 차이가 거의 없는 것으로 나타난다.

⑩ Fig. 3(j)에는 방위각 27도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. BMP2 및 BTR70과 함께 T72(S/N : 812) 표적영상에 대한 유사도가 낮고 T72(S/N : 132) 영상과의 유사도는 0.981로 산출되는데, 맨 좌측영상에 (1)~(2)로 표시한 강한 산란점들과의 위치 및 세기 유사성이 유사도 결정에 크게 관여하는 것으로 분석된다.

⑪ Fig. 3(k)에는 방위각 276도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. 이 방위각에서는 표적의 앞부분이 3시 방향에서 다소 아래로 기울어져 있으며, (1)로 표시한 표적의 우측 부분을 따르는 레이더 반사특성에 의해 유사도 산출이 크게 좌우된다. 이 부분에 있어 유사성이 높은 맨 우측 영상의 경우 유사도가 0.903으로 산출되었으며, 우측에서 두 번째 영상의 경우, (1) 부분에 있는 중간의 강한 산란점을 제외하고 나머지 부분에서 유사성이 떨어져서 0.653의 유사도가 산출된다. BMP2 및 BTR70 표적영상의 경우 (1) 부분에서의 유사성이 없으므로 낮은 유사도가 산출된다. Table 1의 SSIM 값은 산란점과 같은 레이더 반사특성과는 무관하며, 일례로 BTR70의 표적영상이 0.771이라는 높은 SSIM 값을 보임을 들 수 있다.

⑫ Fig. 3(l)에는 방위각 345도/내림각 15도인 T72(S/N : 132) 표적영상의 유사도 산출결과를 나타내었다. 해당 방위각에서는 표적의 앞부분이 5시 방향을 향하고 있으며, 기준영상에서는 (1)~(3)로 표시한 부분이 주요 산란점으로 나타남을 알 수 있다. 이러한 측면에서, 맨 우측의 표적영상이 주요 산란점 간 일치도가 매우 높아, 유사도가 1에 가깝다.

⑬ Fig. 3(m)에는 방위각 358도/내림각 15도인 T72(S/N : 132) 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. 이 방위각은 0도와 매우 가까워 표적 앞부분이 6시 방향을 향하고 있는 경우로서, (1)~(3)로 표시한 표적 전면 및 동체 중심부의 산란점 분포에 따라 유사도 값이 좌우된다. 맨 우측 영상의 경우, 표적형태 및 가장 강한 산란점 (1)의 유사성이 크지만, 산란점 (2)~(3)의 분포에 차이가 발생하여 0.900의 유사도가 산출된다. Table 1. SSIM 값 또한 해당 영상과의 유사도가 0.761로 가장 높으나, BMP2 표적영상과의 유사도가 0.721로 산출되어 육안 관측 결과와 상이한 수치를 제공함을 알 수 있다.

앞선 다양한 해석사례에서는 주로 동일한 표적 및 동일한 시리얼 번호(T72, S/N : 132)를 갖는 표적영상 간의 유사도가 주로 높게 산출되었으나 그렇지 않은 경우도 존재한다. 주로 동종의, 다른 시리얼 번호(T72, S/N : 812)를 갖는 표적에 대해서 가장 높은 유사도가 산출되는 경우인데, 후미의 연료통과 같이 시리얼 번호에 따른 표적 구조의 차이가 레이더 반사특성에 적게 반영되는 방위각에서 발생한다. 이 요인은 동일한 표적뿐만 아니라 다른 표적(BMP2 또는 BTR70)에 대해서도 특정 방위각에 따라 발생할 수 있다. 또다른 요인은 표적의 측면 반사에 의해 강한 산란점이 뭉쳐져서 나타나는 경우로서, 산란점의 분포보다는 표적의 형태가 유사도 산출에 더 큰 영향을 미친다. 이는 주로 방위각 90도 및 270도 근방에서 발생할 수 있다.

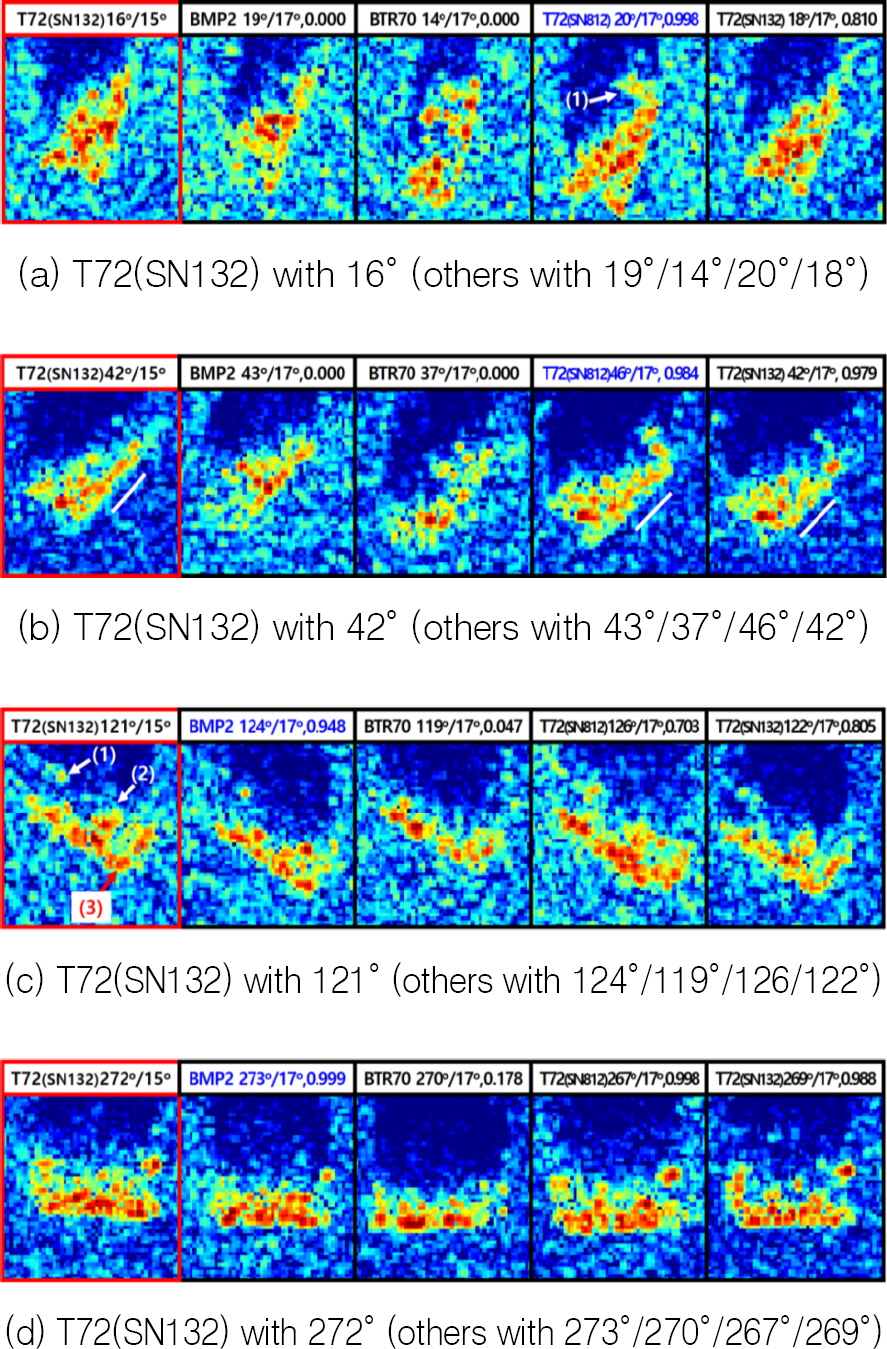

Fig. 4에는 이러한 경우 일부에 대하여 내림각 15도인 T72(S/N : 132)표적영상의 방위각 별로 비교대상 표적 4종(내림각 17도) 각각에 대한 유사도 산출결과를 나타내었다. 또한 Table 2에는 Fig. 4의 각 해석사례별 SSIM과 본 논문에서 제시되는 Siamese 네트워크 유사도를 함께 나타내었다. Fig. 4 및 Table 2의 표시 방식은 Fig. 3 및 Table 1의 그것과 동일하다.

① Fig. 4(a), 방위각 16도/내림각 15도 T72(S/N : 132) 의 경우, BMP2 및 BTR70 표적영상과는 유사도가 거의 없는 것으로 산출되었지만, T72 표적영상의 경우 시리얼 번호가 다른 표적과의 유사도가 0.998로 가장 높게 산출되었다. 육안 관측상으로는 T72 (S/N : 812) 표적영상에 (1)로 표시한 바와 같이 후미 부분에 레이더 반사특성이 나타나지만, 다소 약하여 네트워크가 이를 표적의 산란점으로 인식하지 못한 것으로 추정된다.

② Fig. 4(b), 방위각 42도/내림각 15도 T72(S/N : 132)의 경우, 두 T72 표적영상 과의 유사도가 모두 높게(0.984, 0.979) 산출되는데, 이렇게 후미 구조에 의한 레이더 반사특성 차이가 적게 나타나는 방위각에서는 T72(S/N : 812) 표적영상의 유사도가 유사도 0.01 이내에서 더 높게 나타나는 경우가 많다. 이 경우에서는 흰색 사선으로 표시한 부분을 따르는 산란점의 분포 측면에서 T72(S/N : 812) 표적영상과의 유사도가 더 높음을 발견할 수 있다.

③ Fig. 4(c), 방위각 121도/내림각 15도인 T72(S/N : 132)의 경우 내림각 17도 BMP2 표적영상과의 유사도가 가장 높게 나타난다. T72(S/N : 812)의 영상은 맨 좌측의 기준영상과 비교 시, 표적의 길이가 길어 상대적으로 낮은 0.703의 유사도를 나타낸다. 맨 우측 T72(S/N : 132)의 영상은 맨 좌측 영상에 나타낸 주요 산란점 부분((1)~(3)로 표시)에서 BMP2 표적영상보다 유사성이 낮아 유사도 0.805가 산출되는 것으로 분석된다. Table 2의 SSIM도 변별력은 적으나, BMP2 표적영상과의 유사도가 가장 높은 것으로 산출된다.

④ Fig. 4(d), 방위각 272도/내림각 15도인 T72(S/N : 132)는 표적의 측면에 대한 반사가 큰 경우로서, 네트워크가 산란점 분포보다는 표적형태에 치중하여 유사도를 산출한다. BMP2 표적영상과의 유사도가 0.999로 가장 높고, 두 T72 표적영상과의 유사도 또한 0.998과 0.988이다. 반면에 BTR70 표적영상과는 육안으로도 유사성이 낮은 만큼 이것이 Siamse 네트워크 유사도 값에 반영된다(0.178). Table 2의 SSIM은 T72(S/N : 132) 표적영상과의 값이 가장 크지만, BTR70과 같이 육안 관측상의 낮은 유사성을 반영하지 못한다.

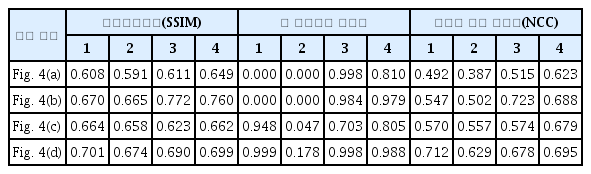

3.3 내림각 15도, BMP2 영상과의 유사도 분석

본 논문의 Siamese 네트워크는 내림각 15도인 T72 (S/N : 132) 표적영상으로 표적영상 간 유사성 판별방법이 학습되었으나, 구조적 특성상 학습에 이용된 표적영상과의 유사도 산출에만 국한되지는 않는다. Fig. 5에는 내림각 15도인 BMP2 표적영상의 방위각 별로 비교대상 표적 4종(내림각 17도) 각각에 대한 유사도 산출결과를 나타내었다. 즉 Fig. 1(a)의 T72(S/N : 132) 표적영상으로 학습이 수행된 Siamese 네트워크의 ‘image 1’ 입력에 내림각 15도의 BMP2 표적영상이 입력되는 것이며, ‘image 2’ 입력은 동일하다. Table 3에는 Fig. 5의 각 해석사례별 SSIM과 본 논문에서 제시되는 Siamese 네트워크 유사도를 함께 나타내었다. Table 3의 ‘1~4’ 숫자는 내림각 15도인 BMP2 표적영상과 내림각 17도의 표적 4종 각각과의 유사도를 나타낸다. 그 외의 표시방식은 이전과 동일하다.

① Fig. 5(a)에는 방위각 42도/내림각 15도인 BMP2 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. 여기서는 3.2장과는 달리 T72의 두 표적영상 모두에 대해 유사도가 낮은 것으로 산출되고, BTR70 표적영상과의 유사도가 상대적으로 높은 0.396이 산출되는데 비해, 동일한 표적인 BMP2 표적영상에 대해서는 (1)로 표시한 표적 중심의 강한 산란점 및 그 주변의 산란점 분포의 유사성으로 인해 0.926의 높은 유사도가 산출된다.

② Fig. 5(b)에는 방위각 87도/내림각 15도인 BMP2 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. Fig. 3(d)와는 달리 여기서는 동일한 표적의 영상과의 유사도가 (1), (2)로 표시한 강한 산란특성으로 인해 0.988로 매우 높다. Table 3에 나타난 경향과 동일하게 T72(S/N : 812) 표적영상과도 0.729의 비교적 높은 유사도가 나타나는데, 강한 산란특성이 나타나는 부분인 (1)과의 유사성이 반영된 것으로 해석된다.

③ Fig. 5(c)에는 방위각 119도/내림각 15도인 BMP2 표적영상과 내림각이 17도인 4종의 표적영상 각각과의 유사도 산출결과를 나타내었다. 여기서는 두 BMP2 표적 영상 간 표적의 후미 부분(우측 하단)에 존재하는 강한 산란점의 세기 상 유사성은 높지만 위치가 다소 다르고, 표적의 앞부분의 산란점 분포에 차이가 있는 것 외에는 전반적인 유사성이 높으므로 0.914의 유사도가 산출된다.

3.4 Siamese 네트워크 유사도의 표적식별 적용

이제까지는 두 표적영상 간 실제 산출된 유사도 값을 바탕으로 표적영상에 나타난 표적 부분의 형태나 강한 산란점의 분포 등과 같은 외형적인 요소와 함께 정성적인 분석을 수행함으로써, 산출된 유사도 값의 타당성을 입증하고자 하였다. 그러나 이러한 표적영상 간의 유사도를 다수의 표적영상 간의 상대적인 비교에 적용하면 그것이 곧 SAR 표적식별이다. 다만, 서포트 벡터머신(Support Vector Machine, SVM)이나 합성곱 신경망(CNN)과 같은 식별기법은 지도학습(super-vised learning) 기반이므로 표적영상을 특정부류(class)로 특성화시키는 핵심 특징을 추출하는 쪽으로 학습된다. 즉, 표적영상 레벨에서의 육안관측 상의 유사성이 반드시 그에 상응하는 분류 또는 식별로 이어지지 않을 수 있다. 반면에 Siamese 네트워크 유사도는 두 표적영상의 유사도를 사람의 주관적인 평가에 동기화되도록 수치를 산출한다는 의도에 의해 고안된 것이다. 따라서 3.4장의 Siamese 네트워크 유사도는 최상의 표적식별 기법으로서가 아니라, 표적영상 간 육안 관측상의 유사성과 식별성능 간 상관관계를 보이기 위해 제시된다.

Table 4에는 Siamese 네트워크 유사도를 표적식별에 적용한 결과를 혼동행렬(confusion matrix)의 형태로 나타내었다. ‘시험’이라고 나타낸 부분은 유사도 산출의 참조영상이 되는 ‘image 1’에 입력한 표적영상의 표적 종류이고, ‘예측’이라고 나타낸 부분은 ‘image 2’에 입력되어 ‘image 1’에 입력한 표적영상과 가장 높은 Siamese 네트워크 유사도를 갖는 표적영상의 표적 종류를 의미한다. T72 옆 ()에 표기된 수치는 시리얼 번호를 의미하고, 표적 명 아래에 있는 ()에 표기된 수치는 내림각을 의미한다. 예를 들어, ‘image 1’에 내림각 17도인 T72(S/N : 812)의 표적영상(방위각 별 총 231개)을 입력하였을 때, 그 중 내림각 17도 BMP2 표적영상과의 유사도가 가장 높은 경우는 0건이며, 동일표적/동일 내림각을 갖는 T72(S/N : 812) 표적영상과의 유사도가 가장 높은 경우는 230건이라는 의미이다. ‘Pcc’는 올바르게 분류될 확률(probability of correct classification)로서, 각 행 별 총 표적영상의 개수 대비 동일한 표적으로 분류된 개수의 비율을 %로 환산하여 나타낸 것이다.

① 첫 번째 행과 두 번째 행은 시험 표적과 예측 표적 간의 내림각이 모두 같으므로 표적식별 성능으로서의 의미는 없으나, Siamese 네트워크가 기존에 내림각 15도인 T72(S/N : 132) 표적영상으로 학습된 만큼, 다른 표적에 대해서도 올바르게 유사성이 학습되었는지는 확인하는 의미가 크다. 시리얼 번호만 다른 동종의 표적에 대해서는 99.33 %의 높은 식별 확률이 산출되고, 표적 종류가 다른 BMP2 표적에 대해서도 92.27 %의 식별 확률이 산출된다.

② 세 번째 행은 Fig. 3과 Fig. 4에서 수행한 바와 동일하며, 모든 방위각에 대해 수행한 결과를 단순 식별 횟수로 나타낸 것이다. ‘image 1’에 입력하는 시험 표적영상과 ‘image 2’에 입력하는 표적영상 간 내림각이 다르기 때문에, 방위각이 유사하더라도 레이더 반사특성이 달라질 수 있다는 것은 앞선 해석사례에서도 확인한 바 있다. Fig. 3과 Fig. 4에서 수행한 바와 같이 BMP2 및 BTR70 영상과 가장 높은 유사도가 산출되는 사례는 상대적으로 적으나, 동일표적(119건) 외에 시리얼 번호가 다른 동종의 표적에 대해서도 높은 식별 횟수인 58건이 산출된다. 이를 식별 확률로 환산 시, 61.34 %에 불과하나 타 연구의 확장운용조건(EOC)에 대한 식별 성능 산출 시[7,8]와 동일하게 동종의 표적에 대한 확률로 재계산하면 91.24 %가 산출된다.

③ 네 번째 행은 Fig. 5에서 수행한 바와 동일하며, 식별 확률은 70.98 %이 산출되었다. 이는 Fig. 5(d)에서 언급한 바와 같이, BMP2 표적영상에 대한 유사성/비유사성 학습이 부재하여 BTR70 표적에 대해 44건의 높은 오식별 횟수를 산출함에 따른 결과이다. 다만 T72 식별결과와는 반대로 BMP2 식별결과에서는 두 종류의 T72 표적영상에 대해서는 오식별 횟수가 상대적으로 적음을 알 수 있다.

④ Table 4의 결과를 도출하기 위해 오로지 T72(S/N : 132) 표적영상으로만 Siamese 네트워크를 학습시킨 것을 감안하면, 학습에 활용되지 않은 표적영상에 대해서도 높은 표적식별 성능을 제공하였다고도 해석할 수 있으므로 일정부분 few-shot 내지 zero- shot 학습의 결과를 보여주기도 한다. 특히 내림각이 15도로 동일한 경우에는, 동종의 T72(S/N : 812) 표적영상에 대해서는 100 %에 가까운 식별확률을 냄으로써 다양한 형태(configuration)에 강인한 모습을 보였으며, BMP2 표적영상에 대해서는 사실상 BMP2 학습영상이 없이도 효과적으로 식별을 수행한 zero-shot 학습의 특성을 보여주었다.

3.5 부류 활성화 맵을 이용한 분석

여기서는 Fig. 6과 같이 부류 활성화 맵(Class Activation Map, CAM)을 이용하여 Fig. 3에 나타낸 내림각 15도의 T72(S/N : 132) 표적영상과 가장 유사한 내림각 17도의 표적영상들을 분석한다. 이를 통해 네트워크가 어떠한 부분이 참조하는 영상과 비교하는 영상이 상호 유사하다고 판별하였는지를 간접적으로 확인할 수 있으며, 데이터에 의한 학습결과이므로 앞서 수행된 정성적인 분석과는 다소 다를 수 있다. 분석은 지면관계상 Fig. 3(a)/(e)/(h)/(k)에 한하며, 해당되는 내림각 15도 T72(S/N : 132) 표적영상의 방위각은 각각 26°, 110°, 180°, 276°이다.

① Fig. 6(a)은 Fig. 3(a) 분석사례를 CAM으로 나타낸 것으로서, 유사도가 낮은 표적영상은 활성화가 주로 클러터 쪽에 집중되어 있으나, 동종표적의 영상의 경우에는 표적 부분에 집중된다.

② Fig. 6(b)은 Fig. 3(e) 분석사례를 CAM으로 나타낸 것으로서, 유사도가 각각 0.962, 0.973으로 높은 동종표적의 영상은 주로 표적의 앞쪽(영상의 좌측)부분에서 유사성을 판단한 것으로 보인다.

③ Fig. 6(c)은 Fig. 3(h) 분석사례를 CAM으로 나타낸 것으로서, 내림각 17도의 T72(S/N : 812) 및 T72 (S/N : 132) 영상의 활성화 양상으로부터 정성적 분석사항과 상당부분 일치함을 알 수 있다.

④ Fig. 6(d)은 Fig. 3(k) 분석사례를 CAM으로 나타낸 것으로서, 정성분석과는 달리 표적 우측면의 강한 산란점에서 유사성 활성도가 집중되지는 않았으며, 표적 전반에 걸쳐있는 것으로 관측된다.

4. 결 론

본 논문에서는 Siamese 네트워크 기반 SAR 표적영상 간의 유사도 분석기법을 제시하였다. 레즈넷을 기본 요소로 하는 Siamese 네트워크 구조로부터 MSTAR 표적영상을 이용하여 네트워크 학습 및 유사도 값을 산출하였고, 표적영상에 대한 정성적인 분석을 곁들여 산출된 값의 타당성을 검증하였다. MSTAR 표적영상을 활용하여 분석한 결과 본 논문에서 제시한 Siamese 네트워크 유사도가 SAR 표적영상에 대해서 육안의 관측결과와 부합하고, SAR 표적영상의 형태 및 주요 부분을 구성하는 산란점 분포간 유사성을 더 잘 반영하는 등 기존의 SSIM 보다 더 변별력 높고 우수한 유사도 분석 성능을 제공하였다. 이어진 표적식별로의 적용을 통해 Siamese 네트워크 유사도와 표적식별 성능 간의 연관성을 보였다. 그러나 본 논문에서 제시된 기법은 MSTAR 표적영상 데이터 셋에 한하여 유용성을 보였다는 한계가 있으며, 이를 범용적으로 적용하기 위해서는 다음의 과제를 해결해야 한다.

① Siamese 네트워크 학습을 위한 ‘similar’ 영상 선정 시, 본 논문에서는 간단한 평행이동 데이터 증대 기법을 이용하였으나 영상 값의 scale에 의한 증대나 다른 센서로 획득한 영상의 확보와 같은 보다 일반적인 방안이 요구된다.

② 2.2장에서 언급한 바와 같이 Siamese 네트워크의 학습영상 쌍을 어떤 방식으로 선정하느냐에 따라 산출되는 유사도가 달라질 수 있다. 본 논문에서의 네트워크 학습 시, 표적영상 간 방위각이 다르면 모두 ‘dissimilar’한 표적영상으로 처리하였다. 이는 방위각이 조금만 달라도 산란점이 크게 달라지는 SAR 영상의 특성 상 타당해보일 수 있으나, 작은 오차에 의해 낮은 유사도를 출력할 수도 있으므로 유사도 분석의 경직성이 야기될 수 있다. 따라서 다양한 학습영상 쌍을 시험해봄으로써 유사도 분석의 정확성과 유연성 간의 최적점을 찾아야 한다.

③ 단일 종류의 표적만으로 Siamese 네트워크를 학습시키면 다른 종류의 표적영상 간에 발생하는 유사성과 비유사성에 대한 정보를 학습하지 못하기 때문에 범용성을 높이기 위해서는 다른 형태를 갖는 표적영상도 학습에 반영해야 한다. 또한 본 논문에서는 클러터 영역을 배제하기 위한 조치(표적영상 자르기 및 평행이동에 의한 증대)를 취하였으나, 표적영상 자체에 주어진 클러터를 활용하였다. 클러터는 제안된 Siamese 네트워크 유사도뿐만 아니라, Fig. 3(h)에서 해석한 바와 같이 SSIM에도 영향을 주었다. 이러한 측면에서, 2.2장에서 언급한 바와 같이 다양한 클러터에서 획득되었거나 모사한 표적영상을 추가적으로 활용하는 것도 일반성 향상에 도움이 될 것이다.

④ 서론에서 언급한 바와 같이 실측영상과 예측영상 간 유사도를 산출하여 SAR 표적영상 예측의 정확도도 가늠할 필요가 있다. 이 경우, 실측영상의 수량이 대개 적으므로 네트워크 학습 시에는 예측영상을 활용해야 한다.

⑤ 본 논문에서 사용된 Siamese 네트워크에서의 유사도 산출은 아웃라이어에 대한 민감도 측면에서 L1- norm 기반으로 수행되었으나, L2-norm을 통해 아웃라이어의 영향을 관측하거나 부류 간 최소거리를 사전 정의하는 contrastive 손실 및 3개의 샘플을 동시에 활용하는 triplet 손실 등을 시험 적용함으로써 최적의 유사도 산출 방법을 고안해야 한다. 또한 최근 인공지능 분야의 빠른 발전 속도로 인하여 Siamese 네트워크 외에도 많은 거리지표 기반의 유사도를 산출하는 딥러닝 기법이 많이 등장하고 있다. 이를 고려하면 Siamese 네트워크보다 진보된 방식의 SAR 표적영상 간 유사도 산출방식을 고려하는 것도 연구결과의 신뢰성을 높이는 방법이 될 것이다.