|

|

- Search

| J. KIMS Technol > Volume 25(6); 2022 > Article |

|

Abstract

Since the concept of Manned-UnManned Teaming(MUM-T) and Unmanned Aircraft System(UAS) can efficiently respond to rapidly changing battle space, many studies are being conducted as key components of the mosaic warfare environment. In this paper, we propose a rule-based AI engagement model based on Basic Fighter Maneuver(BFM) capable of Within-Visual-Range(WVR) air-to-air combat and a simulation environment in which human pilots can participate. In order to develop a rule-based AI engagement model that can pilot a fighter with a 6-DOF dynamics model, tactical manuals and human pilot experience were configured as knowledge specifications and modeled as a behavior tree structure. Based on this, we improved the shortcomings of existing air combat models. The proposed model not only showed a 100 % winning rate in engagement with human pilots, but also visualized decision-making processes such as tactical situations and maneuvering behaviors in real time. We expect that the results of this research will serve as a basis for development of various AI-based engagement models and simulators for human pilot training and embedded software test platform for fighter.

ėÆøė ģ ģ„ ķź²½ģ ģķ ė° ģģ ź°ė

ģ ė³ķģ ė°ė¼ ķź²©ģķģ²“ź³(Kill-Chains)ė” ģ§ķķź³ ģģ¼ė©°[5], ź³ ģ¬ģ/ź³ ė¹ģ©ģ ģė¹ė ėØģ¼ ģ²“ź³ ģ¬ģ“ģ ģ¬ģ ģ ģė ģ ė³“źµķģ ģ ģ ģø źµ¬ģ”°ė„¼ ź°ģ§ ė³µķ©ģ²“ź³(System of System) ė³“ė¤ ģ ģ°ķ ģ ė³“ ź²½ė”ė„¼ ķµķ“ ė ė§ģ ģ§ķģ²“ź³ ė° ķź²©ģ²“ź³ė„¼ ģ°ź²°ķ ģ ģė ģ ģķ ķ¬ģ¹(Kill Web) ź°ė

ģ“ ėģ

ėź³ ģė¤. ėķ, ė¤ģķ ė¬“źø°ģ²“ź³ź° DNA(Data, Network, AI(Artificial Intelligence) źø°ģ źø°ė° ģ“ģ°ź²° ė¤ķøģķ¬ė„¼ ķµķ“ ģ źø°ģ ģ¼ė” ģ°ź²°ėģ“ ź°ģģ ģ°°, ģ§ķķµģ ė° ģ ė°ķź²©ģ“ ė¬ģ±ė ģ ģėė” ģė¬“ ģ¤ķ ėģģ ģģė¤ģ“ ģ¬źµ¬ģ± ė ģ ģė ėŖØģģ“ķ¬ģ ź°ė

ģ¼ė” ė³ķķź³ ģė¤.

ėÆøźµģ 2018ė

ė¶ķ° źµź°ė°©ģģ ėµģ ģ 3ģ°Ø ģģģ ėµģ ė°ģķģ¬ ģøź³µģ§ė„, ė”ė“, ė¬“ģøģ²“ź³ ė± ģģØ ģģ¤ķ

ź°ė°ģ ź³ ėķķź³ ģė¤. ź·øģ¤ģģė ė¬“ģø ģ ķ¬źø°ė ķØź³¼ģ ģø ģė¬“ ė° ģģ ģ ģķķźø° ģķ“ ģ“źø°ģ¢

ģ ģ¼ģė”ė¶ķ° ģø”ģ ė ģ ė³“ė„¼ ģµķ©ķģ¬ ģ¤ģź° ģķ© ģøģģ ķµķ“ ģ ģø ģ ķ¬źø° ģ”°ģ¢

ģ¬ģ ģģ¬ź²°ģ ģ ģ§ģķźø° ģķ ź“ė Ø źø°ģ ģ“ ė·ė°ģ¹Ø ėģ“ģ¼ ķė¤. ķ¹ķ, ģ źø°ģ źø°ė ģ ģ ģ ķģ

ķģ¬ ģźµ° ė¬“ģøźø°ģ ģģØ źø°ėģ ź²°ģ ķź³ , ģ“ė„¼ ėØė

ģ¼ė” ģķķ ģ ģė ģøź³µģ§ė„ źø°ė° ģģØ źø°ė ģ°źµ¬ź° ģ ģ¤ķ ģźµ¬ėė¤. ģ ķ¬źø° ģ ģøģ”°ģ¢

ģ¬ė źµģ ģ¤ ė°ģ ź°ė„ķ ėŖØė ź²½ģ°ģ ėķ“ ėģ²ķ ģ ģėė” ģ¶©ė¶ķ ģź°ģ źµģ”ź³¼ ķė Øģ ė°ģ§ė§, ė¬“ģø ģ ķ¬źø°ģ ź²½ģ°ģė ģ¶©ė ė°©ģ§, ģė ė¹ķ ė° ģ“āģ°©ė„ źø°ė„ ė±ģ¼ė” ģ ķģ ģø ė²ģģģ źµ¬ķ ė° ź°ė°ėģ“ ģģ“ ģøź° ģģ¤ģ ģģ ģģØķź¹ģ§ė ė§ģ ģ°źµ¬ź° ķģķ ź²ģ¼ė” ķėØėė¤.

ź·øė źø° ėė¬øģ ėÆøźµ źµė°©ė¶ė ź³µź²©, ģ ģ°°, ģ ģģ ė±ģ ģė¬“ė„¼ ģ āė¬“ģø ķź³µźø°ź° ķģ

ķģ¬ ģķķė ė”ģ ģė§Ø(Loyal Wingman) ź³¼ģ ė„¼ ķµķ“ ģ ģø ģ ķ¬źø°ė„¼ ģėŖØģ±ģ ģ ė¹ģ© UAS(Unmanned Air System)ė” źµģ²“ķź±°ė ģ ź·¹ ķģ©ķģ¬ ķØģØģ ģø ģė¬“ ģķź³¼ ģ ķ¬źø°ģ ģģ”“ģ±ģ ė³“ģ„ķė ė°©ģģ ģ°źµ¬ķź³ ģė¤[6]. ėķ, DARPAė ģ ė¢°ķ ģ ģź³ , ķģ„ ź°ė„ķ ź³µģ¤źµģ ģ ģķķźø° ģķ“ ACE(Air Combat Evolution) ķė”ź·øėØ[7]ģ ķµķ“ ģøź° ģģ¤ģ AI ķģ¼ėæ ź°ė°ģ ģ§ķķź³ ģė¤. ACE ķė”ź·øėØģ ź°ė°ė AI ź³µģ¤źµģ ėŖØėøģ ģ¤ģ ģ ķ¬źø°ģ ķģ¬ķģ¬ ģ ė¢°ģ±ģ ź²ģ¦ķź³ ģ ģø ģ”°ģ¢

ģ¬ģģ ķģ

ź°ė„ģ±ģ ź²ģ¦ķė ź²ģ ėŖ©ķė” ķź³ ģė¤. ź·øė¬ė ė¬“ģøģ ķ¬źø° ģģ¤ķ

ģ ź“ķ ė§ģ ģ°źµ¬ė¤ģ“ ģ§ķėź³ ģģģė ė¶źµ¬ķź³ ģ ķµģ ģø ź³µģ¤ ģ ķ¬ģ źø°ė³øģė¦¬ ė° ģģ¹ģ ķ¬ź² ė³ķź° ģė ģķ©ģ“ė¤. ģµģ ė¬“ģ„ ģ“ģ©ģ“ė ģė¬“ ģ¬ź³ķ, ź²½ė” ģ¬ģ¤ģ ė±ģ ģķ ģģ¬ź²°ģ ģ ģ ģø ģ ķ¬źø° ģ”°ģ¢

ģ¬ģ ėģģ ė°ėė¤ ķėė¼ė, ķØģØģ ģø ė¬“ģøģ ķ¬źø°ģ ģ“ģ©ģ ģķ“ģė źø°ė³øģ ģø ź³µģ¤ ģ ķ¬ ė„ė „ģ ź°ģ§ ģøź³µģ§ė„ źø°ė° ź³µģ¤ źµģ ėŖØėø źø°ģ ģ ź°ģ„ ķµģ¬ģ ģ“ź³ ķģķ ģģė¼ź³ ķ ģ ģė¤.

ģ“ė„¼ ģķ“ ė³ø ė

¼ė¬øģģė ė¬“ģøģ ķ¬źø°ź° Dog-fightģ ź°ģ ģź³ ė“(WVR) ź³µģ¤ģ ģ ģ±ź³µģ ģ¼ė” ģķķ ģ ģėė” ź³µźµ°ģ ģ ģ źµė² ė° ģ”°ģ¢

ģ¬ ź²½ķģ ė°ķģ¼ė” ź³µėź³µ źµģ ģķģ ģķ ģ§ģėŖ

ģøģė„¼ źµ¬ģ¶ķģė¤. ź° ģ ģ ėØģ(ź³µź²©, ė°©ģ“ ė±) ė³ ķģ ź²°ģ ķė”ģøģ¤ė„¼ DBķ ķģź³ , ģ“ė„¼ źø°ė°ģ¼ė” ķøė¦¬ źµ¬ģ”°ė„¼ ķģ©ķģ¬ ģ ķ¬źø° źø°ėģ ź²°ģ ķė ķģ ėŖØėøģ ģ¤ź³ķģė¤. ģ ģ„ ģķ©ģ ė°ė¼ ģ ģøģ”°ģ¢

ģ¬ģ źø°ė ķģė„¼ ź²°ģ ķė ģģ¬ź²°ģ ė°©ģģ ė¹ ėŖ

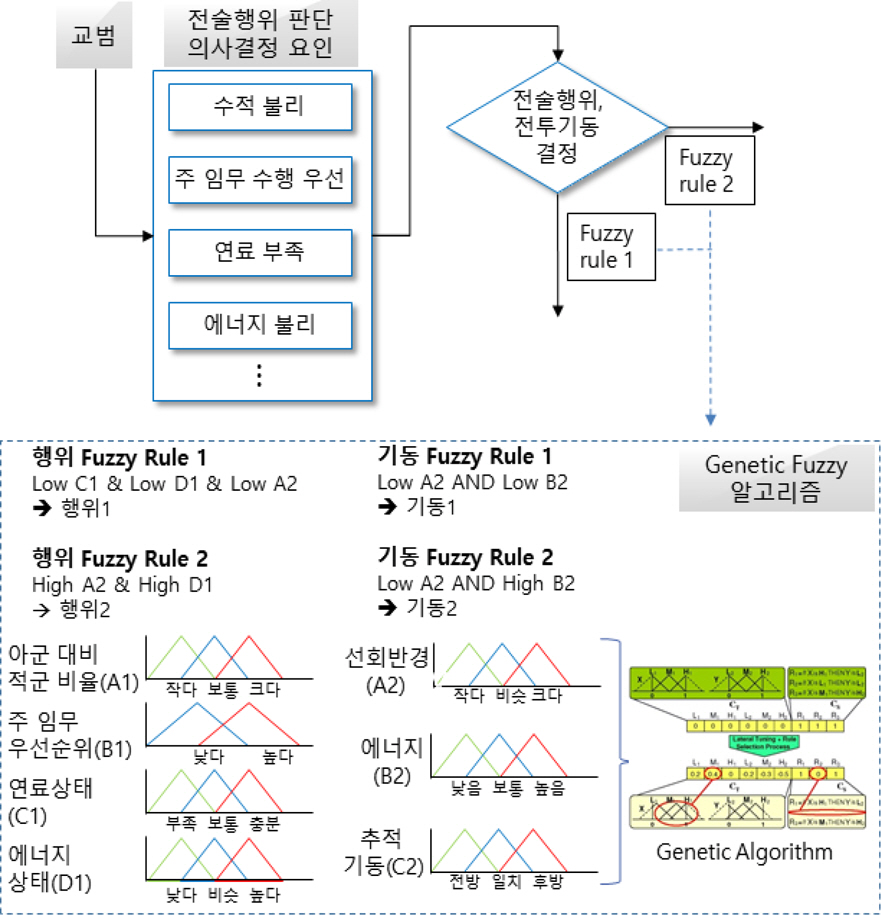

ģģ ģ“ė©° ģ ėģ ģ¼ė” ģė³ķźø° ģ“ė µźø° ėė¬øģ ģ“ė„¼ ė¬“ģøģ ķ¬źø°ģ ģ ģ©ķźø° ģķ“ Genetic-Fuzzy ģź³ ė¦¬ģ¦[8]ģ ķģ©ķģė¤. Genetic-Fuzzy ģź³ ė¦¬ģ¦ģ ķµķ“ źø°ė ķģ ź²°ģ ģ ķģķ ķ¼ģ§ ė³ģģ ź° ė©¤ė²ķØģė¤ģ źµ¬ź° ź°ģ ķėķģ¬ ģµģ ģ źø°ėģ ź²°ģ ķź³ ģ źø°ģģ ģķģ ģ°ģė„¼ ķėØķėė° ģ¬ģ©ķģė¤.

ģ“ė„¼ ė°ķģ¼ė” ģ¤ź³ė ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģģ¹, ź°ė ė± ģ źø°ģģ źø°ķ ģ ė³“, ģ°ė£ė, ģė ė±ģ ģķ ź°ģ ģ

ė „ģ¼ė” ė°ģ ģ ķ¬ ģķ©ģ ķėØķź³ ģµģ ģ źø°ėķģė„¼ ź²°ģ ķģ¬ ė¹ķ ģ¶ģ ģ ģ ģģ±ķź³ ģ“ė„¼ ģ¶ģ¢

ķė ģ ģ“ ėŖ

ė ¹ ź°ģ ģģ±ķź² ėė¤. ģ ģ“ ėŖ

ė ¹ģ ė°ė¼ ģģ±ė Stick, Throttle, Rudder ė±ģ ģ”°ģ¢

ź°ģ ģ¤ķģģ¤ ģ ķ¬źø° ėģķ ėŖØėøģø JSBSim[9]ģ ģ ģ©ķģ¬ 6-DOF ėģķ źø°ė°ģ ģ ķ¬źø° źø°ėģ źµ¬ķķģė¤.

ģ°ė¦¬ė ģ ģķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ±ė„ģ ķź°ķź³ ź²ģ¦ķźø° ģķ“ģ ģøź° ģ”°ģ¢

ģ¬ģ ź·ģ¹źø°ė° AI źµģ ėŖØėø ź°ģ źµģ ģ ģķķė¤. źµģ ģ¤ķģ ģ§ķķźø° ģķ ģė®¬ė ģ“ģ

ķź²½ģ ģøź°ģ”°ģ¢

ģ¬ģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø ź°ģ źµģ ģ ė¬¼ė” ģ“ź³ , ģøź°ģ”°ģ¢

ģ¬ģģ ķģ

ėŖØģė„¼ ģ§ģķź³ ģµė 2:2 źµģ ģ“ ź°ė„ķėė” ģ¤ź³ėģė¤. źµģ ģ ģ°øģ¬ķė ź°ģ²“(ģøź°ģ”°ģ¢

ģ¬ ķ¹ģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø)ė¤ģ ģ¬ģ ģ¤ģ ģ“ ź°ė„ķė©°, ģ ģ²“ ģė®¬ė ģ“ģ

ķź²½ģ ģøź°ģ”°ģ¢

ģ¬ ķ¹ģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģ”°ģ¢

ź°ė„ķ ģė®¬ė ģ“ķ° 2ģ, ģ“ģ© ķµģ ģ, ėŖØģ ģė² ė° FOV(Field Of View) 240Ā°~110Ā°ė„¼ ģ§ģķė ė ģ¤ķ¬ė¦° ė±ģ¼ė” źµ¬ģ±ėģė¤. 2ėŖ

ģ ģøź°ģ”°ģ¢

ģ¬ģ ź·ģ¹źø°ė° AI źµģ ėŖØėø ź° ģ“ 10ė²ģ ź·¼ģ ź³µģ¤źµģ ģ ģķķģź³ ź·ģ¹źø°ė° AI źµģ ėŖØėøģ“ 100 %ģ ģ¹ė„ ģ źø°ė”ķģė¤.

ģøź°ģ”°ģ¢

ģ¬ė„¼ ģėė” ķ ģ±ź³µģ ģø źµģ ź²°ź³¼ ėæė§ ģėė¼, ģ ģė ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøź³¼ ģė®¬ė ģ“ģ

ķź²½ģ źø°ģ”“ ģ ė¬øź° ģģ¤ķ

ģ“ ź°ź³ ģė ģ ė¬øź° ģģ”“ ė¬øģ , ģ ģ© ėģ ė° ķź²½ ė³ķģ ė°ė¼ ė°ģķė ź·ģ¹ ź°±ģ ģ ė²ź±°ė”ģź³¼ ģź°ģ“ ė§ģ“ ģėŖØėė ėØģ ė¤ģ ķ“ź²°ķė¤. ėķ, ź°ķķģµ, ė„ė¬ė ė± źø°ź³ķģµ ģź³ ė¦¬ģ¦ ė°©ģė¤ģ źµģ ģķ©ģģ ģ¼ź“ė ģ±ė„ ė³“ģ„ģ“ ģ“ė µź³ ėøėė°ģ¤ ķķģ ģė ė°©ģģ¼ė” ģģ±ė ź·ģ¹ģ ź²ģ¦ģ“ ė¶ź°ė„ķ ė¬øģ ė„¼ ķģ ķøė¦¬ źµ¬ģ”°ģģ ź²°ģ ė ķģė„¼ źµģ ģ¤ ģ¤ģź°ģ¼ė” ķģøķ ģ ģėė” ģė®¬ė ģ“ģ

ķź²½ģ ģ¤ź³ķģź³ ģ¤ķģ ķµķ“ ģ“ė„¼ ź²ģ¦ķģė¤. ģ“ė¬ķ ź²°ź³¼ė¤ģ ė°ķģ¼ė”, ģ°ė¦¬ė ė³ø ģ°źµ¬ź° ģ ķ¬źø° ģ”°ģ¢

ģ¬ė¤ģź² ģ ģ ė° źµģ ģģ ź³ķģ ģķ ģ ģ ģė®¬ė ģ“ģ

ķź²½ģ ģ ź³µķź³ ģ“ė³“ ģ ķ¬źø° ģ”°ģ¢

ģ¬ė„¼ ģķ źµė² źø°ė°ģ ķė Ø ķź²½ģ ģ ź³µķ ģ ģģ ź²ģ¼ė” ė³øė¤. ź·øė¦¬ź³ ė¤ģķ AI ģź³ ė¦¬ģ¦ źø°ė°ģ ź³µģ¤źµģ ėŖØėø ė° UAS ķģ¬ ģģØķ ģė¬“ź“ė¦¬ ģķķøģØģ“ ź°ė°ģ ģķ źø°ģ“ź° ė ź²ģ¼ė” źø°ėķė¤.

ė³ø ė

¼ė¬øģ źµ¬ģ±ģ ė¤ģź³¼ ź°ė¤. 2ģ„ģģė ź³µģ¤źµģ ėŖØģė„¼ ģķ ź“ė Ø ģ°źµ¬ė¤ģ ė¶ģķė¤. ģ“ķ 3ģ„ģ ķµķ“ ģ ģķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø ģ¤ź³ ė“ģ©ģ źø°ģ ķź³ ģ“ė„¼ ģ ģ©ķź³ ź²ģ¦ķźø° ģķ ģė®¬ė ģ“ģ

ķź²½ģ 4ģ„ģģ ģ¤ėŖ

ķė¤. 5ģ„ģģė ģ ģė ėŖØėøģ ģ¤ķ ė° ź²ģ¦ ź²°ź³¼ė¤ģ ė¶ģķź³ 6ģ„ ź²°ė” ģģ ź°ģ ģ ź³¼ ķ„ķ ģ°źµ¬ ė°©ķ„ģ źø°ģ ķė¤.

ģ ķ¬źø° ź³µģ¤źµģ ėŖØģ ėŖØėøģ ģķ źø°ģ”“ģ ģ ķµģ ģø ģ ź·¼ė²ģ ģ ģø ģ ķ¬źø° ģ”°ģ¢

ģ¬ģ ķėģ ėŖØė°©ķźø° ģķ“ ģ ė¬øź°ģ ģķ ź·ģ¹ źø°ė° ģģ¤ķ

ģ ź°ė°ķź±°ė ķ“ė¦¬ģ¤ķ± ģ ė³“ źø°ė° ģģ¤ķ

, ė¶ė„ģ ė°©ģ(Classifier System)ģ ģ ģ ģ ģź³ ė¦¬ģ¦ źø°ė° ź°ķķģµ źø°ė² ė° źø°ź³ķģµ ģź³ ė¦¬ģ¦ģ ģ ģ©ķ ģ°źµ¬ė¤ģ“ ģė¤.

Burgin et al.ģ ģ°źµ¬[10,11]ė ź° źµģ ģķ©ģ ėķ ė¤ģķ ź·ģ¹ģ ģģ±ķź³ ģ“ė„¼ źø°ė°ģ¼ė” ź³µģ¤ ėŖØģ ģė®¬ė ģ“ģ

ģ źµ¬ģ±ķģė¤. ź·øė¬ė ģ“ė¬ķ ź·ģ¹ źø°ė° ģģ¤ķ

ģ ź°ģ„ ķģ¤ģ ģø źµģ ģė®¬ė ģ“ģ

ź²°ź³¼ė„¼ ė³“ģģ§ė§ źµģ ģķ© ģ ė°ģ ėķ ź·ģ¹ģ“ ķģķź² ėėÆė” ėŖØė ģķ©ģ ėķ ģøė¶ģ ģø ź·ģ¹ģ ėÆøė¦¬ ģ¤ģ ķ“ģ¼ ķė ė²ź±°ė”ģģ“ ģģ¼ė©° ėģ ģ ķ¬źø°ģ ė°ė¼ ź·ģ¹ ź°±ģ ģ ģź°ģ“ ė§ģ“ ģėŖØėė ėØģ ģ“ ģė¤. Kahneman et al.ģ ģ°źµ¬[12]ģģė ėÆøė źø°ė ģ¤ ź°ģ„ ėģ źø°ė ģ ģė„¼ ź°ė źø°ėģ ź²°ģ ķź³ ģ ķķė ė°©ģģ ģ ģ©ķģė¤. ģ“ė„¼ ķµķ“, źµģ ģė®¬ė ģ“ģ

ź²°ź³¼ė ģ¼ė¶ ź°ģ ėģģ¼ė ģģ ģøźøķ ģ ė¬øź° ģģ¤ķ

ģ ėØģ ģ ķ“ź²°ķģ§ė ėŖ»ķė¤.

ķ“ė¦¬ģ¤ķ± ģ ė³“ źø°ė° ģģ¤ķ

[13]ģ ģ ė³“ģ§ķ„(Information oriented) ģė®¬ė ģ“ģ

ģķ¤ķ

ģ³ė„¼ ź·¼ź°ģ¼ė” ģė®¬ė ģ“ģ

ģ ģķķė¤. ģ¼ģ, ģź° ė° ķµģ ė±ģ ķ¹ģ ķ ź°ģ“ ėŖ

ģė ģ ė³“ ķė ģ“ė²¤ķøė„¼ ķµķ“ ģė®¬ė ģ“ģ

ģ“ ģķėė¤. ģ¬źø°ģģ ź° ģ”°ģ¢

ģ¬ė ė°°ģ“ ķģ

ģ ė©ķ ėŖØėø(Mental Models)ģ ź°ģ§ź³ ģėė°, ģ“ź²ģ ėė(Surprise), ķ¼ė(Confusion) ė± ģķ©ģ ģ§ź°ķė ķ¹ģ ź°ģ ģ”°ģ¢

ģ¬ź° ź°ģ§ ģ ė³“ė§ģ¼ė” ģķ© ķź°(Situation Assessment)ź° ģ“ė£Øģ“ģ§ė¤. ģ“ė ė¤ė„ø ģė®¬ė ģ“ģ

ź°ģ²“ė¤ģ ź·øė¤ģ ķėģ ź³ģķė¤ė ź°ģ ķģ ķ“ė¦¬ģ¤ķ± ķØģė„¼ ķµķ“ ėŖ©ķė¬ģ±ģ ģø”ģ ķź³ ķėØ źø°ģ¤ź°ģ ė°ė¼ ķź³µźø°ģ źø°ėź³¼ ė¬“ģ„ģ ģ“ģ©ķė¤. ģ“ ė°©ģģ ģ”°ģ¢

ģ¬ģ ź²½ķģ ė°ķģ¼ė” ķźø°ģ ź²°ź³¼ ź°ģ ėķ ģ ė¢°ģ±ģ ź°ģ§ė§ ģķ©ķėØģ ģ”°ģ¢

ģ¬ ź°ģģ ė§ģ(Mind)ģ ė°ė„ø ķ¹ģ ź°ģ źø°ģ¤ģ¼ė” ķė ėØģ ģ“ ģė¤.

Holland et al.ģ ė

¼ė¬ø[14]ģģė źø°ģ”“ ź·ģ¹ źø°ė° ģģ¤ķ

ģ źµ¬ģ¶ķė ģģģź°ģ ėØģ¶ķź³ źµģ ģķ© ģ ģ²“ģ ėķ ģµģ ķ“ė„¼ ź²°ģ ķźø° ģķ“ ė¶ė„ģ ė°©ģģ ģ ģ ģ ģź³ ė¦¬ģ¦ źø°ė° ź°ķķģµ ė°©ė²ģ ģ¬ģ©ķģė¤. ģ“ ģ°źµ¬ė ģ¶ė „ ķøķ„ ģ ģ“ź° ź°ė„ķ ģ ķ¬źø°ģ ģ ģ źø°ėģ ģ¬ė¬ ģķ©ģ ėķ ķė Øģ ķµķ“ ź·ģ¹ģ ģģ±ķėė” ķė ė°©ģģ ģ“ģ©ķė¤. ģ“ė„¼ ģķ“ģ ź° źµģ ģķė„¼ ė°ģ“ėė¦¬ ķķė” ė¶ė„ķź³ ģø”ė©“ź° ź°ģ ėŖ©ģ ķØģė” ģ¤ģ ķ“ ź°ķķģµģ ģķķģė¤. ź°ķķģµ[15] źø°ė²ģ ģ ģ©ķė©“ ė¤ģķ ģ ķ¬źø° ėŖØėøģ“ė ģ”°ģ¢

ģ¬ź° ģ ģ“ķźø° ģ“ė ¤ģ“ ė¹ķ ģģź¹ģ§ ģ ģ źø°ėģ ģė®¬ė ģ“ģ

ķź³ ź·ģ¹ģ ģģ±ķ“ ė¼ ģ ģė ģ„ģ ģ“ ģė¤. ķģ§ė§ ģģ±ė ź·ģ¹ģ ź²ģ¦ģ“ ė¶ź°ė„ķź³ źµģ ģķ©ģģ źø°ėėė ģ¼ź“ė ģ±ė„ ė³“ģ„ģ“ ģ“ė µė¤ė ė¬øģ ź° ģė¤.

Genetic-fuzzy ģź³ ė¦¬ģ¦ģ ė¤ė„ø źø°ź³ķģµ ė°©ģė¤ģ ė¹ķ“ ėģ ź³ģ° ķØģØģ±ģ ź°ģ§ ėæė§ ģėė¼ ė¶ķģ¤ķź³ ė¬“ģģģ±ģ ź°ķ ķ¹ģ§ģ ź°ź³ ģė¤. ź·øė źø° ėė¬øģ ėģ ģ¼ė” ė³ķķė ģėė¦¬ģ¤ģ ģ ģķ ģ ģź³ ģ¤ģ ģ ė°ė„ø ģ§ź“ģ ģø ģė ė°©ģģ¼ė” ź³¼ģ ź³¼ ź²°ź³¼ģ ėķ ź²ģ¦ģ“ ź°ė„ķźø° ėė¬øģ ģ ģ“ ė¬øģ ģ ėė¦¬ ģ¬ģ©ėź³ ģė¤[16~18]. ė¬“ģø ģ ķ¬ķź³µźø°(UCAV) ģė¬“ė„¼ ģė®¬ė ģ“ģ

ķźø° ģķ“ Ernest et al.ģ ģ°źµ¬[19]ģģė Genetic Fuzzy Tree(GFT)ė„¼ ķģ©ķ ėŖØėøģ ģ ģķė¤. ģ ķ¬ģ”°ģ¢

ģ¬ģ ź°ģ ģ ė¬øź°ź° ģ¬ģ ģ ģķ ģ

ė „ź°ģ“ ģ¬ė¬ ź°ģ ķ¼ģ§ ģ¶ė” ķØģė” źµ¬ģ±ė ķøė¦¬ źµ¬ģ”°ģ ģ ģ©ėģ“ ģė¬“źø ģ ķ¬ ģķ©ģģ ģµģ ģģ¬ź²°ģ ģ ģ§ģķė źµ¬ģ”°ė„¼ ź°ź³ ģė¤. ė¬“ģø ģ ķ¬ķź³µźø°ģ ģė¬“ ģķģ ėŖ©ģ ģ¼ė” ģ ģ ėØģ ź³µź²©, ģ¹Øķ¬, ķķ¼ ė±ģ źø°ėģ ģ ģ“ķźø° ģķ“ 0ģģ 100ģ¬ģ“ģ ķė„ ź°ģ ģ¶ė „ķė ė°©ģģ ģ ģ©ķė¤. ė³µģ”ėź° ėź³ ėģ ģø źµģ ģķ©ģ ķØź³¼ģ ģ¼ė” ėŖØģķźø° ģķ ķ©ė¦¬ģ ģø ģ ź·¼ ė°©ė²ģ ģ ģķģ§ė§, ģė¬“źø źµģ ėŖØģė„¼ ėģģ¼ė” ķźø° ėė¬øģ ź·¼ģ ź³µģ¤źµģ ģ ģ ģ©ķźø°ģė ė¬“ė¦¬ź° ģė¤.

ģ ķ¬źø° ģ”°ģ¢

ģ¬ģ ģ¬ģ ģ§ģģ“ ź³µģ¤źµģ ģ ģķ ģ ģ ķė Øģ źø°ģ¤ģ“ ėė źø°ģ”“ ķź²½ģģ ģ”°ģ¢

ģ¬ģ ģøģź³¼ ķėģ ėģ¼ķź² ėŖØģķ ģ ģė¤ė©“ ģ ķ¬źø°ė, ė¹ķģ ģ“ ė± ė ėģ ģģ¬ź²°ģ ėģ¶ģ“ ź°ė„ķ ź²ģ“ė¤. ź·øģ¤ģģė WVR ź·¼ģ ź³µģ¤źµģ ģ ėŖØģķźø° ģķ“ģė ź³µź²©, ė°©ģ“, ģ¤ė¦½ ģķ©ģģ źø°ėģ ź²°ģ ķźø° ģķ źø°ė³øģ ķ¬źø°ė(BFM, Basic Fighter Maneuvers)ģ ėķ ź³¼ģ

/ķģ ėŖØėøģ źµ¬ģ¶ķź³ ģ ķ¬źø° ģ”°ģ¢

ģ¬ė”ė¶ķ° ģ¬ģ ģ ģė³ė WVR ź·¼ģ ź³µģ¤źµģ ģ§ģģ ė°ķģ¼ė” ķ AI ģ”°ģ¢

ģ¬ ėŖØėøģ“ ź°ė°ėģ“ģ¼ ķė¤. ģ“ė„¼ ģķ“ ė³ø ģ„ģģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø ģķ¤ķ

ģ³ģ ģ“ė„¼ źµ¬ģ±ķė ģ§ģėŖ

ģø ķģķøė¦¬, ģ ģ ķģ ėŖØėø, ķģ ź²°ģ ģ ģķ ź·ģ¹źø°ė° ģģ¬ź²°ģ ėŖØėź³¼ 6-DOF ėģķ ė° ģ ķ¬źø° ė¹ķģ ģ“ė„¼ ģķ ģ”°ģ¢

ģ ģ“ ėŖØėøģ ėķ“ źø°ģ ķė¤.

WVR ź³µģ¤ģ źµģ ź·ģ¹ ė° ģ ģ ė±ģ ģ ķ¬źø° ģ±ė„ģ ė§ź² źµė²ģ“ė źµģ ź·ģ¹ ė±ģ¼ė” źø°ģ ėģ“ ģģ¼ė©° ģøė¶ ź³¼ģ

ģ ģ°Øė ģ”°ģ¢

ģ¬ ź°ģøģ ģķ© ķėØģ ė°ė¼ ģ§ķėź³ ģė¤. ģ“ģ ė³ø ģ°źµ¬ģģė ź³µėź³µ źµģ ź·ģ¹, ģ ģ źµė²ź³¼ źø° źµ¬ģ¶ė ź°ģź³µģ¤źµģ ėŖØėø[1] ė° ź°ė³ķ ģ ģ ģė®¬ė ģ“ķ°[2]ģ źµģ ė°ģ“ķ°ė„¼ ķģ©ķģ¬ źø°ė³øģ ķ¬źø°ė(BFM)ģ 1ė1 ź³µź²© ė° ė°©ģ“ źµģ ź·ģ¹ ė° ģ ģ ģ ķģ¤ķķģ¬ ėŖØėøė§ģ ģķķė¤. ģ“ė„¼ ė°ķģ¼ė”, źµģ ź·ģ¹ źø°ė° AIģ”°ģ¢

ģ¬ źµģ /ź³¼ģ

ģķ ėŖØėøģ ź°ė°ķź³ , ė¤ėė¤ źø°ģ¢

ė³ ėģ ģ ģ ģ ķģ¤ķķģ¬ 1ė2, 2ė1 ė° 2ė2 źµģ ėŖØģź° ź°ė„ķėė” ķė¤. źµ¬ģ¶ė ź³µėź³µ źµģ ź·ģ¹ź³¼ ź³¼ģ

ģķ ėŖØėøģ ģķ ģ§ģėŖ

ģøė ģ ė¬øź°(ģ ķ¬źø° ģ”°ģ¢

ģ¬) ģė¬øź³¼ ė³ėģ ź²ģ¦ź³¼ģ [3]ģ ķµķ“ ģ ķØģ±ź³¼ ģ ė¢°ģ±ģ ķė³“ķė¤.

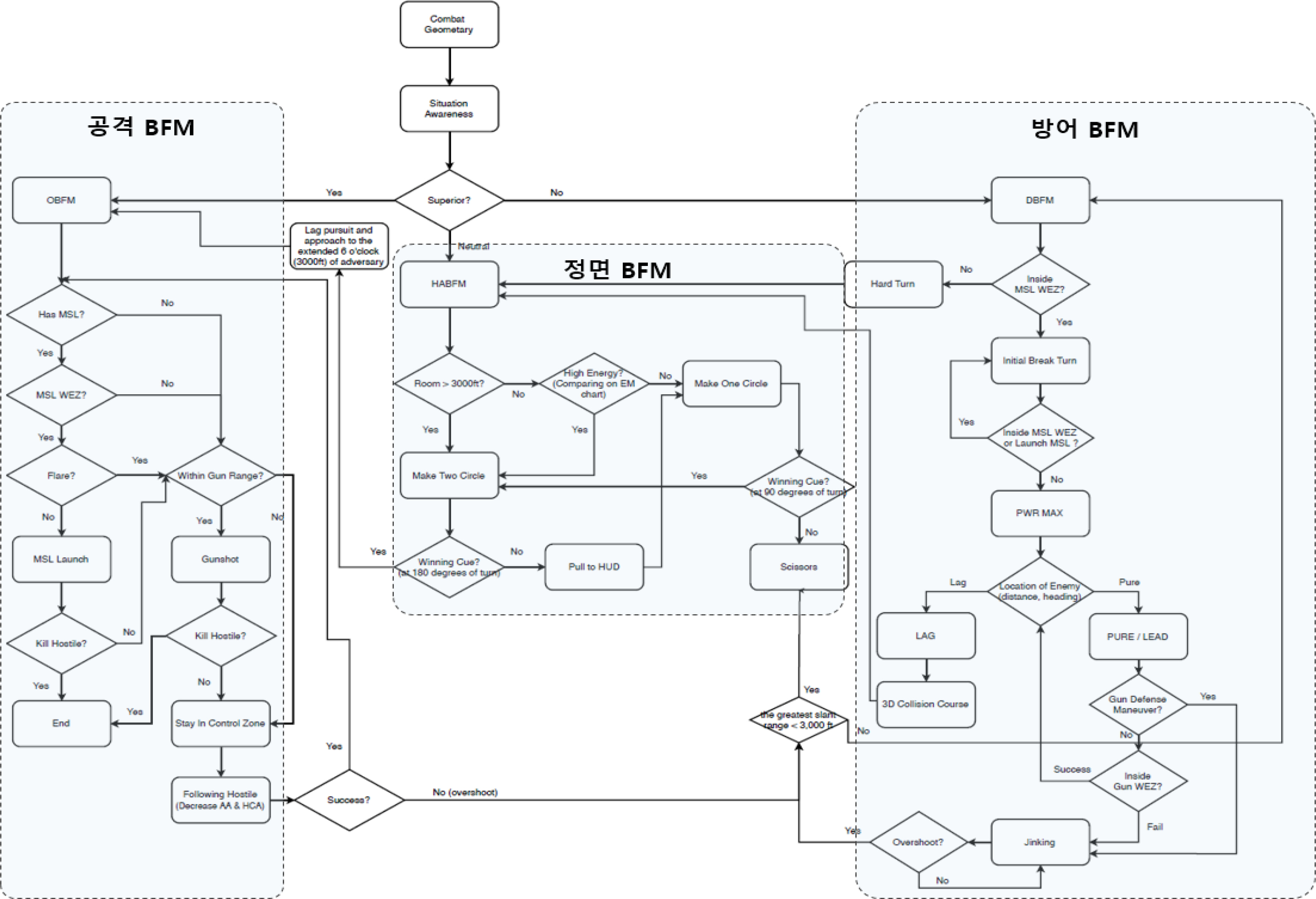

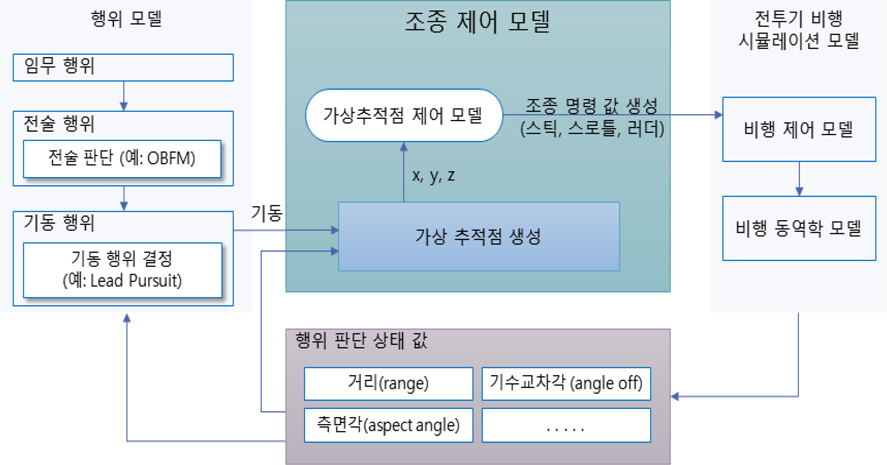

ė³ø ģ°źµ¬ģģ ģ ģķė ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģķ¤ķ

ģ²ė Fig. 1ź³¼ ź°ė¤. ģ ģė ėŖØėøģ ķ¬ź² ģ ķ¬ ģķ©ź³¼ ķģė„¼ ķėØķźø° ģķ“ ģ

ė „ ź°ė¤ģ ģ²ė¦¬ķė ģķ©ģøģ ėŖØė, ģ ķ¬ ģ¤ ģ ė¦¬ķ ģķ©ģ ģ ģ ķźø° ģķ ķģ ėŖØėø, ķģėŖØėøģģ ź²°ģ ė źø°ėģ ģķķźø° ģķ“ ģ ķ¬źø°ė„¼ ģ ģ“ķė ģ”°ģ¢

ģ ģ“ėŖØėøė” źµ¬ģ±ėė¤.

ģķ©ģøģ ėŖØėģ ģ ķ¬źø° ķģ¬ ģ¼ģģ ģ źø°ģģ źø°ķģ ė³“ ė±ģ ė°ķģ¼ė” ģ ķ¬źø° ķģģ źø°ėģ ķėØķźø° ģķ ģ ė³“ė„¼ ė“ė¹ķė¤. ģ ķ¬źø°ķķģģė ģźµ°źø°ģ ģ źø° ź°ģ ģėģ ź±°ė¦¬, Aspect Angle, Heading Cross Angle, Antenna Train Angleź³¼ ź°ģ 4ź°ģ§ ģģė¤ģ ģķ“ ģ“ė ģ ķ¬źø°ź° ģ°ģė„¼ ź°ģ§ėģ§ ķģ

ķ ģ ģė¤. ģ“ė„¼ ė°ķģ¼ė” ģ°ė¦¬ė ģ ķ¬ ģ“źø° ģ”°ź±“ ėæė§ ģėė¼ ģ ķ¬ ģ§ķ ģķ©ģģ ė§¤ ģź° ģźµ°źø°ź° ģ źø°ģ ėķ“ ģ°ģø, ģ“ģø ķ¹ģ ėė±ķģ§ė„¼ ķėØķė źø°ė„ģ¼ė” ķģ„ķģė¤.

ģ źø°ģ ģźµ°źø°ģ ģģ¹ ź“ź³ė„¼ ķµķ“ ģźµ°źø°ź° ķģ¬ ģ¤ė¦½/ź³µź²©/ė°©ģ“ ģ¤ ģ“ė¤ ģķ©ģøģ§ė„¼ ģė ¤ģ£¼źø° ģķ“ģ ė ģ“ė, GPS/INS ė± ģ ķ¬źø° ķģ¬ ģ¼ģė”ė¶ķ° ģø”ģ ėė ė°ģ“ķ°ė„¼ ź°ź³µķģ¬ ģ źø°ģģ ź±°ė¦¬, ź°ė, ģė ė° ģėģģ¹ ė±ģ ķ¹ģ§ ė°ģ“ķ°ė„¼ ģ¶ģ¶ķź³ ėØģ ģ°ė£ė, ģėģ§ ė±ģ ģ ė³“ģ ź²°ķ©ķ“ ģµģ ģ źø°ėģ ģ ķķźø° ģķ ķėØ ģ ė³“ė„¼ ģ ź³µķė¤. ģ ķķ ģķ©ģøģģ ģ źø°ģ ģźµ°źø°ģ ź°ėė§ģ ģ“ģ©ķ ģė ģź³ , ź°ėģ ź±°ė¦¬ ķ¹ģ ź°ė, ź±°ė¦¬, ź³ ė, ģėė„¼ ģ¢

ķ©ķ“ģ ź³ ė ¤ķ ģė ģė¤. ė³ø ģ°źµ¬ģģ ģķ©ģøģģ ģźµ°źø°ģ ź“ģ ģģ ģ źø°ģź² ģ°ģøķ ģķ©ģø OBFM(Offensive Basic Fighter Maneuvers), ė¶ė¦¬ķ ģķ© DBFM(Defensive Basic Fighter Maneuvers), ėė±ķ ģķ© HABFM(High-Aspect Basic Fighter Maneuvers)ģ¼ė” źµ¬ė¶ķė¤.

OBFMģ ģ źø°ė„¼ ģ¶ź²©ķė ģķ©ģ¼ė” ėÆøģ¬ģ¼ ģ ė¬“, WEZ(Weapon Engage Zone) ģ§ģ

ģ¬ė¶, źø°ģźµģ°Øź° ė±ģ ģ źø°ģģ ģėģ ė³“ ė±ģ ė°ķģ¼ė” źø°ėģ ģ ķķė¤. DBFMģ ģ¶ģ ė¹ķė ģķ©ģģ ģķķė ģ ģ ė”, ģ źø°ģ ģ¶ģ ģķģ ķź²½ģ ė³“ė„¼ ė°ķģ¼ė” ģ ė¦¬ķ ģ§ģ ģ ķė³“ķźø° ģķ źø°ėģ ģ ķķė¤. HABFMģ ģø”ė©“ź°ģ“ ėź±°ė ėė±ķ ģķ©ģģģ ģ ģ ė”, ģ źø°ģ ėģģ ģģ¹ ģ ė³“ė„¼ ė°ķģ¼ė” One Circle ķ¹ģ Two Circleģ ė§ė¤ė©“ģ ģ ė¦¬ķ ģģ¹ė„¼ ģ ģ ķźø° ģķ źø°ėģ ģķķė¤. ģ ģ ķģ ė³ė” BFM ź³µė źø°ė 12ģ¢

, OBFM ģ ģ© źø°ė 5ģ¢

, DBFM ģ ģ© źø°ė 2ģ¢

, HABFM ģ ģ© źø°ė 3ģ¢

ė± ģ“ 22ģ¢

ė„ģ ģ ķ¬ źø°ėģ ģė³ķź³ ģ“ė„¼ ė°ķģ¼ė” ģ ķ¬źø°ģ ķģ ėŖØėøė§ģ ģ§ķķģė¤.

ģķ©ģøģ ėŖØėģģ ģ ė¬ė ķģ ķėØ ģ ė³“ė ģ ģ ėØģ ķģ ėŖØėøė” ģ ė¬ėģ“ ģµģ ģ ģ ķ¬źø°ėģ ź²°ģ ķź² ėė¤. ģ“ė„¼ ģķ“ ėؼģ ģ ģ źµė² ė° ģ”°ģ¢

ģ¬ ź²½ķģ ė°ķģ¼ė” ģ§ģėŖ

ģøģė„¼ źµ¬ģ¶ķė¤. ģģ ģøźøķ 3ź°ģ§ ģķ©ģøģģ ź°ė

ė¤ź³¼ ķ“ė¹ ģźµ°źø°ģ ģ źø°ģ ź“ź³ ė° źø°ė ģķģ ģ°Øė„¼ ģ ģķė¤. ģķ© ė³ ģ ķ¬źø°ė ģ ģ°Øģ ķėØź·¼ź±° ė±ģ ģė³ķź³ ģ źø°ģ źø°ėģ ė°ė¼ ģźµ°źø°ģ ėģ ģ ģ°Ø ėķ ķ¬ķØķź³ ģė¤. 1ė1, 1ė2, 2ė1, 2ė2 ģķ©ė³ źµģ ģķ© ģ¤ ģ ģ źµė²ģ ģė ģźµ°źø°ź° ģģ ģ“ģøģ“ź±°ė 2ė2ģø ģķ©ģ ėķ ģ§ģėŖ

ģøė ģ”°ģ¢

ģ¬ģ ģź²¬ģ ė°ķģ¼ė” ģģ±ķģė¤.

źµ¬ģ¶ė ģ§ģėŖ

ģøģė Fig. 2ģ ź°ģ“ ķøė¦¬ źµ¬ģ”°ė„¼ ķģ©ķģ¬ ģ ģ ķģ ė³ ģ ķ¬źø° źø°ėģ ź²°ģ ķźø° ģķ ķģ ėŖØėøė§ģ ģķķė¤. ķģėŖØėøģ ķģķøė¦¬(Behavior Tree) źµ¬ģ”°ė„¼ ķģ©ķģ¬ ģķ©ģøģ ėŖØėė”ė¶ķ° ģ ė¬ė ģ ė³“ė”ė¶ķ° ģ“ė¤ źø°ėģ ģ ķķ“ģ¼ ģ źø°ė³“ė¤ ģ ė¦¬ķ ģķ©ģ ģ ģ ķ ģ ģėģ§ ķģķøė¦¬ģ źø°ė°ķ źø°ė ź³ķģ ź²°ģ ķė¤. ģ ģ ėØģ ķģķøė¦¬ė„¼ Fig. 3ź³¼ ź°ģ“ ķģ ķė¦ėė” ė³ķķ ķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģµģ ģ ģ ģ ķģė„¼ ėģ¶ķėė° ķģ©ķģė¤.

ź·øė¼ģė ė¶źµ¬ķź³ ģøź° ģ”°ģ¢

ģ¬ė„¼ ģķ ģ ģ ķė Ø źµė²ģ ģķ©ģ ķėØķźø° ģķ ģģź° ģ¶ģģ ģ“ź³ ķķģ“ ėŖØķøķźø° ėė¬øģ ģ źø°ģģ ģķģģ ģ ė¦¬ķØ(Superior)ģ ģ ėģ ģ¼ė” ķėØķźø° ģķ“ Fig. 4ģģ ķķė ź²ģ²ė¼ Genetic-Fuzzy źø°ė°ģ ģµģ ź·ģ¹ ė° źµ¬ź° ź°ģ ėģ¶ķ ģ ģėė” ģ ģ©ķģė¤. ģ ė¦¬ķØģ ķėØķźø° ģķ“ģ ė³ø ģ°źµ¬ģģė ģģ ė¶ė¦¬, ģ£¼ ģė¬“ ģķ ģ°ģ , ģ°ė£ ė¶ģ”±, ģėģ§ ė¶ė¦¬ ė±ģ ģģ¬ź²°ģ ģģė¤ģ ģ ģ©ķė¤. ė¹ ėŖ

ģģ ģ“ź³ ģė³ģ“ ģ“ė ¤ģ“ ź·ģ¹ģ ģė³ķģ¬ ģ ķ¬źø° ģ ģ ķģģ ģ ķ¬źø°ė ź²°ģ ģ ķģķ ķ¼ģ§ė³ģ ė©¤ė²ķØģė¤ģ źµ¬ź° ź°ģ ķėķģ¬ ģµģ ģ źø°ėģ ź²°ģ ķ ģ ģėė” ģ¤ź³ķģė¤. ģ ėģ ģ¼ė” ķėØķźø° ėŖØķøķ ģģė¤ģ Fuzzy ė³ģė” ģė³ķź³ ź·ø ģµģ ź°ģ Genetic ģź³ ė¦¬ģ¦ģ ģ“ģ©ķģ¬ Fuzzy ė©¤ė² ė³ģģ ķė„ ė¶ķ¬ė„¼ ķėķėė°, ģźµ° ėė¹ ģ źµ° ė¹ģØ, ģ£¼ ģė¬“ģ ģ°ģ ģģ, ģ°ė£ģķ ė±ģ ģģ¬ź²°ģ ģģė¤ģ ķ¼ģ§ ė³ģė” ģ¤ģ ķź³ ģ“ė„¼ ė°ķģ¼ė” ģ ģ ķģė„¼ ź²°ģ ķźø° ģķ Genetic-Fuzzy źø°ė°ģ ķ¼ģ§ ź·ģ¹ģ ģ¤ģ ķė¤. ķ¼ģ§ ź·ģ¹ģ ģķ“ ģ ģ ķģź° ź²°ģ ėė©“ ģµģ ģ ģ ķ¬ źø°ėģ ź²°ģ ķźø° ģķ Fuzzy ė©¤ė² ķØģė¤ģ źµ¬ź° ź° ģģ Genetic-Fuzzy źø°ė°ģ ķ¼ģ§ ź·ģ¹ģ ģ ģ©ķģė¤. ģ“ģ²ė¼ ķėė źµ¬ź° ź°ģ ģķ“ ź²°ģ ė źø°ėģ ģ”°ģ¢

ģ ģ“ ėŖØėøė” ģ ė¬ėģ“ ģ ķ¬źø° ģ”°ģ¢

ģ ģķ ģ¶ģ ģ ģģ±ģ ķģ©ėė¤.

ķģ ėŖØėøģģ ź²°ģ ė ģ ģ źø°ėģ ģ”°ģ¢

ģ ģ“ ėŖØėøģ ķµķ“ ģ ķ¬źø° ģ ģ“ź° ģķėė¤. Fig. 5ģģ źø°ģ ķ ģ”°ģ¢

ģ ģ“ ėŖØėøģ ģėģ§ ź“ė¦¬, ģ ķ ė°ź²½ź³¼ ģ¤ģ¬ģ , ķź³µźø° źø°ė ķ¹ģ± ė±ģ ģ“ģ©ķģ¬ ģ ķ¬źø°ģ źø°ė ģģ¹ė„¼ ź²°ģ ķė ģ¶ģ ģ ģ ģģ±ķė¤. 3ģ°Øģ ģ¢ķė” ģģ±ė ģ¶ģ ģ ģ ģ¶ģ¢

ķźø° ģķ ģ¤ķ±(Stick), ģ¤ė”ķ(Throttle), ė¬ė(Rudder) ģ”°ģ¢

ėŖ

ė ¹ ź°ģ¼ė” ģ ķ¬źø°ė„¼ ģ ģ“ķźø° ģķ“ ė³ø ģ°źµ¬ģģė ģ¤ķģģ¤ ėģķ ėŖØėøģø JSBSim ėŖØėøģ ķģ©ķģė¤. JSBSimģ 6-DOF ėģķ ėŖØėøź³¼ ė¤ģķ ģ ķ¬źø°ģ ė¹ķģ ģ“/ģ¶ģ§ ėŖØėøė¤ģ ģ§ģķė¤.

ķ¹ķ, AI ģ”°ģ¢

ģ¬ ėŖØėøģģ ė¹ķģ ģ“ė„¼ ģķ ė¤ģķ ģ ź·¼ģ“ ģģ“ģģ§ė§, ė³ø ė

¼ė¬øģģė ģµģ źø°ėģ ź²°ģ ķź³ ģ¶ģ ģ ģ ģ¶ģ¢

ķė ė¹ķ ģ”°ģ¢

ė°©ģģ ģ ģ©ķģė¤. ģźµ°źø°/ģ źø°ģ ģģ¹, ė°©ķ„ ė° ķź²½ ģ ė³“ ė±ģ ķ¬ķØķė ģķ ź° Sė„¼ ģ

ė „ģ¼ė” ė°ģ ģ ķ¬źø°ė„¼ ģ ģ“ķė ź³¼ģ ģ ķ¬ź² ķėØ(Decision), ģ ė(Guidance), ģ ģ“(Control) ģø ėØź³ė” źµ¬ė¶ėė¤. ķėØ ėØź³ė ģģ źø°ģ ķėė” ķģ¬ ģķė„¼ ė°ķģ¼ė” ģ“ė¤ źø°ėģ ģ ķķ“ģ¼ ģ ė¦¬ķģ§ė„¼ ź²°ģ ķģ¬ ė¹ķ ģ¶ģ ģ ģ ģģ±ķė¤. ģ ė ėØź³ė ķ“ė¹ ģ¶ģ ģ ģ¼ė” źø°ģ²“ė„¼ ģģ§ģ“źø° ģķ ģ¤ķ±, ģ¤ė”ķ, ė¬ė ė±ģ ģ”°ģ¢

ź°ģ ģģ±ķė¤. ė§ģ§ė§ ģ ģ“ ėØź³ė ģ”°ģ¢

ź°ģ ģ“ģ©ķģ¬ ģ ķ¬źø°ģ ė¹ķģ ģ“ė„¼ ė“ė¹ķź³ ģķė„¼ ģ

ė°ģ“ķø ķė¤.

źø°ģ”“ģ Min-max tree search, RL(Reinforcement Learning), GFT źø°ė° heuristic, Fuzzy rule ė± źø°ė²[20~24]ģ ģ ģ©ķ AI ģ”°ģ¢

ģ¬ ėŖØėøė¤ģ ģ¶ģ ģ ė° ģ”°ģ¢

ź° ģģ± ź³¼ģ ģģ“ ģ źø°ģ ģģ§ģė§ģ ģ¶ģ¢

ķźø° ėė¬øģ ģ“ė„¼ ģķ“ ģ¶ė „ėė ģ¶ģ§, ģ ģ“ ėŖ

ė ¹ ź°ė¤ģ ģ ė¢°ģ±ģ ė³“ģ„ķ ģ ģė¤. ėķ, ģ¤ģ ģ ķ¬źø° źø°ė ģķģ ė°ģķ ģ ģź³ ģ ģ©ķė ė¬¼ė¦¬ ģģ§ģ ė°ė¼ ģ ķ¬ ź²°ź³¼ź° ė¬ė¼ģ§ ģė ģė¤. ė°ė©“, ģ ģķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ źø°ģ”“ ėŖØėøė¤ ėė¹ ģø ėØź³ģ ź±øģ¹ ė¹ķ ģ”°ģ¢

źµ¬ģ”°ė” ģ¤ź³ėģ“ ģģ¤ķ

ģ ė³µģ”ėė ė¤ģ ģ¦ź°ķģ§ė§, ėģķź³¼ ė¬¼ė¦¬ ė²ģ¹ģ źø°ė°ķ ģ¤ģ ģ ķ¬ źø°ėģ ėķ ź²ģ¦ģ“ ź°ė„ķź³ ķ¹ģ źø°ė ė³ė” ķģķ ģ”°ģ¢

ėŖ

ė ¹ź°ģ ķģøķ ģ ģźø° ėė¬øģ ėģ ģ¶©ģ¤ėė„¼ ė°ķģ¼ė” ģ“ė³“ ģ”°ģ¢

ģ¬ ķė Øģ ģķ“ģė ķģ©ķ ģ ģė¤. ėķ, ģø ėØź³ģ ź±øģ¹ ģ ģ“ źµ¬ģ”°ė ANN(Artificial Neural Network)[4], Naive Bayesian ėŖØėø[25]ģ ķģ©ķģ¬ ģ¶ģ ģ ģ ź²°ģ ķė ė°©ģģ ģ ģ©ķ ģ°źµ¬ė¤ģģė ģ ģ©ėģ§ė§, ė³ø ģ°źµ¬ė Genetic Fuzzy ģź³ ė¦¬ģ¦ģ ķģ©ķģ¬ ģķė„¼ ķėØķźø° ėė¬øģ ź³ģ°ėģ ģµģķķģ¬ ģ ģķ ģģ¬ź²°ģ ģ“ ķģķ ź³µģ¤źµģ ėŖØėøģ ģ ķ©ķź³ ģ¤ģź°ģ¼ė” źµģ ģķ© ė° ģģ¬ź²°ģ ź³¼ģ ź³¼ ģ”°ģ¢

ėŖ

ė ¹ ź° ķģøė ź°ė„ķė¤.

ģøź° ģ”°ģ¢

ģ¬ģ ģ ķ¬ė„¼ ķµķ“ ģ ģķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ±ė„ģ ź²ģ¦ķźø° ģķ“ ģė®¬ė ģ“ķ°ė„¼ ķ¬ķØķ ģė®¬ė ģ“ģ

ķź²½ģ źµ¬ģ±ķģė¤. ģ¬źø°ģģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ źµģ ė° ģ”°ģ¢

ė„ė „ģ ķģøķ ģ ģź³ ėģź° ģ āė¬“ģø ķģ

ģ ķ¬ ėŖØģė„¼ ź³ ė ¤ķģ¬ ģ¤ź³ė„¼ ģ§ķķė¤. ė³ø ģ°źµ¬ģģė ģ“ė„¼ ģķ“ ģ”°ģ¢

ģ ģė®¬ė ģ“ķ° 2źø°ģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø 2źø°ė„¼ ėģģ ģ“ģ© ź°ė„ķź² ķģ¬ ė¤ģķ ź°ģ²“ ģ”°ķ©ģ¼ė” ģµė 2ė2 źµģ ģ“ ź°ė„ķ ķź²½ģ źµ¬ģ¶ķģė¤.

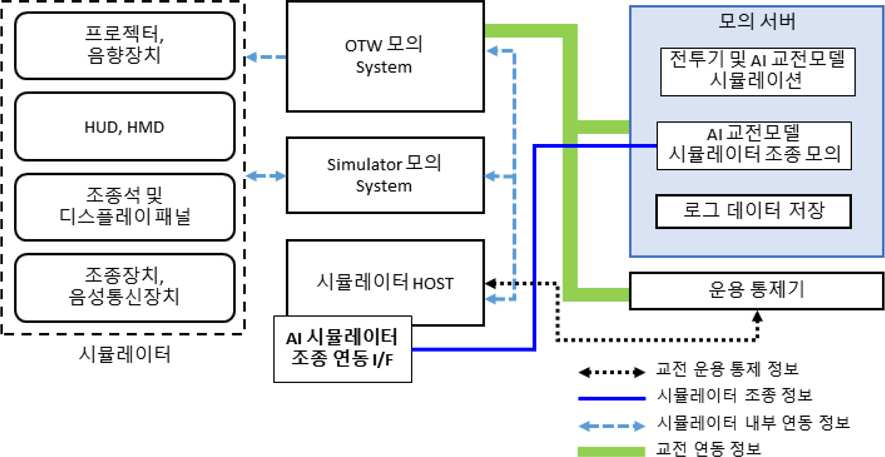

ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģķ ķµķ© ģė®¬ė ģ“ģ

ķź²½ģ Fig. 6ź³¼ ź°ģ“ ģė®¬ė ģ“ģ

ģ“ģ© ķź²½ź³¼ ģė®¬ė ģ“ģ

ģģ¤ķ

ģ¼ė” źµ¬ģ±ėė¤. ģė®¬ė ģ“ģ

ģ“ģ© ķź²½ģ ė¤ģ 4ź°ģ ėŖØė, ź³µģ¤źµģ ėŖØėø(ģźµ°) ė ź³µģ¤źµģ ėŖØėø(ģ źµ°), ź³µģ¤źµģ ėŖØėø ķģ¬ ģė®¬ė ģ“ķ° ė ģøź° ģ”°ģ¢

ģ¬ ķģ¹ ģė®¬ė ģ“ķ°, ź³µģ¤źµģ ėŖØėø ķģ¬ ģė®¬ė ģ“ķ° ė ź³µģ¤źµģ ėŖØėø ķģ¬ ģė®¬ė ģ“ķ° ź·øė¦¬ź³ ź³µģ¤źµģ ėŖØėøź³¼ ģøź° ģ”°ģ¢

ģ¬ģ ģ āė¬“ģø ķģ

ģ“ģ©ģ“ ź°ė„ķėė” ģ¤ź³ėģė¤. ź·øė¦¬ź³ ź³µģ¤źµģ ģ ģ ģ©ķ F-15źø, KF-16źø ė° FA-50źø ģ ķ¬źø°ģ ė¹ķ ėģķ, ė¹ķģ ģ“ ėŖØģ ėŖØėø, ė ģ“ė, RWR(Radar Warning Receiver) ź·øė¦¬ź³ IRST(InfraRed Search and Track) ė±ģ ķģ¬ ģ„ė¹ ėŖØģ ėŖØėø, AIM-9, Gun, Flare ė° Chaff ė± ė¬“ģ„ ė° ķķ¼ ģ„ė¹ ėŖØģ ėŖØėø ė±ģ ź°ė°ķģ¬ ķµķ© ģ“ģ©ģ“ ź°ė„ķėė” ķģė¤.

ģė®¬ė ģ“ģ

ģģ¤ķ

ģ ź³µģ¤źµģ ėŖØėø, ģė®¬ė ģ“ķ°, ģ”°ģ¢

ģ¬ ėŖØėø, ėŖØģ ģģ§ ė° ķģ ėŖØėøė§ ė° ź²°ź³¼ė¶ģ S/W ė±ģ źµ¬ģ±ģģė¤ė” ģ“ė¤ģ ø ģģ¼ė©°, ź° źµ¬ģ±ģģė¤ģ DIS(Distributed Interactive Simulation) ķģ¤ģ ķģ©ķģ¬ ģ ķ¬źø° ė° AI ź³µģ¤źµģ ėŖØėøģ ģķģ ė³“, ėŖØģ ģ“ė²¤ķø ģ ė³“ ė±ģ ź³µģ ķė¤. ķµķ© ģė®¬ė ģ“ģ

ķź²½ģ ģ ķ¬źø° ė° ķģ¬/ė¬“ģ„ ź“ė Ø ėŖØėøė¤ź³¼ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģė®¬ė ģ“ģ

ģģ¤ķ

ģ ķµķ“ źµģ ģ ģķķź² ėė¤. ėķ, ģė®¬ė ģ“ģ

ģģ¤ķ

ģ źµģ ģ ėŖØģķźø° ģķ ģėė¦¬ģ¤ ģ¤ģ , ģ ķ¬źø° ģ¤ģ , źµģ ź²°ź³¼ ė¶ģ ė° ė”ź·ø ģ ģ„/ź“ė¦¬ź° ź°ė„ķėė” ģ¤ź³ėģė¤.

ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø ź²ģ¦ģ ģķ ģė®¬ė ģ“ķ°ė ģøź° ģ”°ģ¢

ģ¬ ėė ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģ”°ģ¢

ķ ģ ģėė” ģė®¬ė ģ“ķ° 2ģź³¼ ģ“ģ© ķµģ ģģ¼ė” źµ¬ģ±ķģ¬ ģ¤ź³ ė° ź°ė°ķģė¤. ģė®¬ė ģ“ķ°ė ģģ¼ź° ģķ 240Ā°, ģģ§ 110Ā°(ā20Ā°~90Ā°) ģģģ ģ§ģķė 3ģ±ė ėģ¤ķ¬ė¦°, F-16/F-35źø/KF-21źø ģ”°ģ¢

ģģ ģ ķģ ģ¼ė” ėŖØģķ ģ ģė ź°ė³ķ ģ”°ģ¢

ģ, Prepar 3Dė„¼ ģ¬ģ©ķ OTW(Out The Window) ėŖØģ PCģ HUD(Head Up Display), MFD(Multi Function Display) ķė©“ģ ėŖØģķė ģė®¬ė ģ“ķ° ėŖØģ PC ė±ģ¼ė” źµ¬ģ±ėė¤.

Fig. 7ģ ģė®¬ė ģ“ķ° źµ¬ģ±ģ ģøė¶ ķėŖ©ģ ķķķ ź²ģ¼ė”, ģ“ė¬ķ źµ¬ģ±ģ ģøź° ģ”°ģ¢

ģ¬ģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ¶ź°ķģ¬ ģµė 2ė2 źµģ ģ“ ź°ė„ķėė” ķģė¤. Host PCģģė ė¬“ģ„, ė ģ“ė, RWR ė±ģ ķģ¬ ģ„ė¹ė„¼ ėŖØģķź³ AI źµģ ėŖØėøź³¼ ģøź° ģ”°ģ¢

ģ¬ź° ź°ģ ģ”°ź±“ģģ źµģ ģ ģķķ ģ ģėė” ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ”°ģ¢

ź° ģ°ėģ ģķ ģøķ°ķģ“ģ¤ź° ģ“ģ©ėė¤. ģ“ė„¼ ķµķ“ źµģ ģ ģķķė ėģ ė°ģ“ķ° ģ°ė ģ§ģ°ģ ģµģķķź³ ėŖØģ ķė ģ ėźø°ķė„¼ ź°ė„ķź² ķģ¬ ģķķ źµģ ģ“ ģķė ģ ģėė” ķģė¤.

ģ“ė„¼ ė°ķģ¼ė” Fig. 8ģ²ė¼ ģ¤ģ źµ¬ģ±ė ģė®¬ė ģ“ķ° ķź²½ģ ķµķ“ źµģ ģ ģķķØģ¼ė”ģØ ģøź° ģ”°ģ¢

ģ¬ģ ź²½ķź³¼ ė

øķģ°ź° ė“źø“ ģ ģ ķėØź³¼ źø°ėķģ ė° źµģ ģķ ź³¼ģ ģ źø°ė”ķź³ ģ“ģ© ķµģ ģģģ ķģøģ“ ź°ė„ķėė” ģ¤ź³ķģė¤. ėķ, ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģģ±ķ ģ”°ģ¢

ėŖ

ė ¹ ź°ģ¼ė” ģė®¬ė ģ“ķ°ź° ėģķėė” ķģ¬ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėø ģģ ģ źµģ ģķ ź³¼ģ ģ ź°ģķ ķ ģ ģė¤.

ģ ķ¬źø°ģ WVR ź³µģ¤źµģ ė„ė „ģ ė¶ģ¬ķź³ ź·øź²ģ ėŖØģķźø° ģķ“ ė³ø ė

¼ė¬øģģ ģ ģķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ±ė„ź³¼ ģ“ģ©ģ±ģ ź²ģ¦ķź³ ķź°ķźø° ģķ“ ź³µźµ° ģ ķ¬źø° ģ”°ģ¢

ģ¬ģ źø°ė³øģ ķ¬źø°ėģ źø°ė°ķ 1ė1 Dog-Fight źµģ ģ ģķķģė¤. źµģ ģģ ģ”°ź±“ģ ģ¤ė¦½ ģ”°ź±“ģ¼ė” ź³ ė(5,000~20,000 ft, 500 ft ėØģ), ģė(300~450 kts, 1 kts ėØģ), ģėź±°ė¦¬(2,000~3,000 ft, 100 ft ėØģ)ė„¼ ģ§ģ ķ ė²ģ ė“ģģ ėØģ ź°ģ źø°ģ¤ģ¼ė” ėė¤ķź² ģ¤ģ ķģė¤. źµģ ź²°ź³¼ė„¼ ķģ ķźø° ģķ ķ¼ķ“ ķź°ė ź°ģģ ź³µź²© ģģģ źø°ģ²“ ģģ ģėæ ķķė” ė°°ģ¹ķź³ ź·ø ė²ģ ģģ ģė źø°ģ²“ź° ė¤ģ“ģ¤ė©“ health gaugeė„¼ ģ°Øź°ķė ģ¤ģ½ģ“ė§ ė°©ģģ ģ ģ©ķģė¤. ź°ģģ ź³µź²© ģģ ė²ģė ģ ķ¬źø° źø°ģ ģ 2Ā°, ģµė 3,000 ft ź±°ė¦¬ė” ģ¤ģ ķģė¤. ģ ķ¬ ģ¹ė¦¬ ģ”°ź±“ģ ģė źø°ģ²“ģ health gaugeė„¼ 0ģ¼ė” ė§ė¤ź±°ė 300ģ“ė” ģ¤ģ ķ ģ ķ¬ ģź° ė“ģ ģėė³“ė¤ ėģ health gaugeė„¼ ģ ģ§ķė ź²ģ¼ė” ģ¤ģ ķģė¤. ź·øė¦¬ź³ źµģ ģ¤ 1,000 ft ģ“ķė” ź³ ėź° ė“ė ¤ź°ė©“ health gaugeź° 0ģ“ ėģ“ ģ¦ģ źµģ ģ“ ģ¢

ė£ėėė” ģ¤ģ ķė¤.

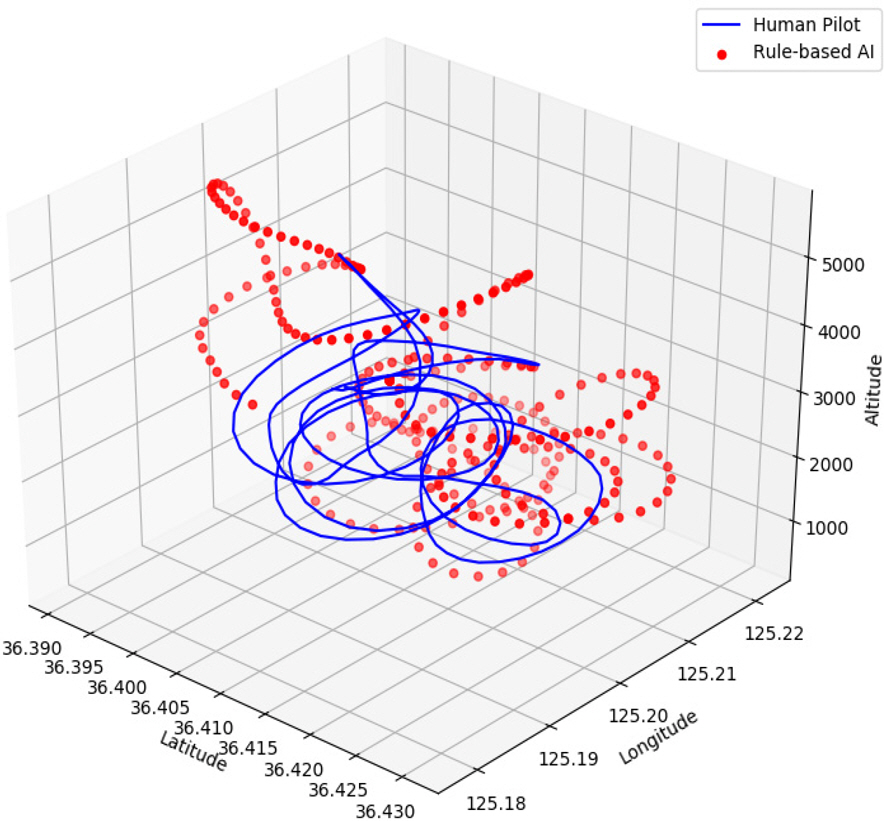

ģ źµģ ģ”°ź±“ģ ė°ķģ¼ė”, ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ±ė„ ź²ģ¦ģ ģķ“ ģøź° ģ”°ģ¢

ģ¬ģģ ź³µģ¤ źµģ ģ ģ§ķķģė¤. źµģ ģķ ģ ģøź° ģ”°ģ¢

ģ¬ģź² 1ģź°ģ ģ ģ ģź°ģ ė¶ģ¬ķ ķ ģ¤ķģ ģ§ķķ ź²°ź³¼, Table 1ģ²ė¼ 2ėŖ

ģ ģ ķ¬źø° ģ”°ģ¢

ģ¬ź° ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģėė” ź° 5ķģ© ģ“ 10ķģ ź³µģ¤źµģ ģ ģķķģź³ , ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ 100 % ģ¹ė„ ģ ė³“ģė¤. ėė¶ė¶ģ źµģ ģ“ 3ė¶ ģ“ė“ģ ģ¢

ė£ė ė§ķ¼ ģ ģ ėŖØėøģ ź³µģ¤źµģ ģ±ė„ģ“ ģ°ģķØģ ķģøķ ģ ģģė¤. ģ“ė¬ķ ź²°ź³¼ė ģė”ģ“ ģ”°ģ¢

ķź²½ģģ ģøź° ģ”°ģ¢

ģ¬ź° ź²Ŗģ ė¶ķģ ėÆģ ģ”°ģ¢

ź°ģ ź³ ė ¤ķėė¼ė ģ ģė ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģøź° ģ”°ģ¢

ģ¬ ģģ¤ģ Dog-fight źµģ ģ±ė„ģ ė³“ģė¤ź³ ķ ģ ģė¤. ķģ§ė§ źµģ ģ“ ė°ė³µ ė ģė” ģøź° ģ”°ģ¢

ģ¬ė¤ģ“ ģ ģ°Ø ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ źø°ėģ ģ ģķė ėŖØģµģ ė³“ģø ģ ģ ė³“ģ, ģ¶©ė¶ķ ģ ģ ģź°ģ“ ģ£¼ģ“ģ§ė¤ė©“ Table 1ģ ź²°ź³¼ģė ė¤ė„ø ģģģ źµģ ź²°ź³¼ź° ėģ¬ ź²ģ¼ė” ģģėė¤.

Dog-fight result of rule-based AI engagement model vs. human pilot

Fig. 9ė ģė®¬ė ģ“ģ

ķź²½ ģ¤ ģ“ģ©ķµģ ģ ķė©“ģ¼ė” źµģ ģ§ķ ģķ©ź³¼ ķģķøė¦¬ė„¼ ķµķ“ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģ ķķ ģ ģ ķģ ė° ģ ķ¬źø°ėģ ģ¤ģź°ģ¼ė” ķģøķ ģ ģģģ ė³“ģ¬ģ£¼ź³ ģė¤. ģźµ°ź³¼ ģ źµ°ģ ė¹ķ ź²½ė”, ģ ķ¬źø° ģģø ė° ģ ė³“ ė±ģ źµģ ģķ©ģ 3ģ°Øģģ¼ė” ģė³ ź°ė„ķź³ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ“ ģ ķķ BFM ģ ģ ķģģ ģ ķ¬ źø°ė ź²°ģ ź³¼ģ ģ ķģķøė¦¬ė„¼ ķµķ“ ź°ģķķģ¬ ģ¶ė „ķė¤. ė„ė¬ėź³¼ ź°ģ źø°ź³ķģµ ģź³ ė¦¬ģ¦ė¤ģ“ ėøėė°ģ¤ ė°©ģģ ģėģ¼ė” ģģ±ė ź²°ź³¼ģ ėķ ģ¤ź° ź³¼ģ ź²ģ¦ģ“ ė¶ź°ė„ķ ė°ė©“, ģ ģ ėŖØėøģ ķģķøė¦¬ė„¼ ķµķ“ ģ ģ ķģģ ģ ķ¬źø°ė ź²°ģ ź³¼ģ ģ ģė³ķ ģ ģģ¼ėÆė”, ģ ķ¬źø° ģ”°ģ¢

ģ¬ė¤ģź² ģ ģ ķģ, źø°ė ė° ģģ ź³ķģ ģķ źµė² źø°ė°ģ ģ ģ ģė®¬ė ģ“ģ

ķė Ø ķź²½ģ ģ ź³µķ ģ ģģ ź²ģ¼ė” ė³øė¤. ėķ, ģ ģø ģ”°ģ¢

ģ¬, ź³µģ¤źµģ AI ź³µģ¤źµģ ėŖØėøģ ģ”°ķ©ķģ¬ ģ āė¬“ģø ė³µķ© ģ“ģ© ź°ė

ģ ė¶ģķź³ ģė¬“ ķØź³¼ė„¼ ķģøķ ģ ģė ģė®¬ė ģ“ģ

ķź²½ģ¼ė”ė ķģ©ķ ģ ģģ ź²ģ¼ė” ģź°ėė¤.

ģ ķ¬ ź²°ź³¼ ė¶ģģ ģķ“ ź³µģ¤źµģ ģ ģķķė©“ģ ģģ§ķ ģ ģė ģ ķ¬źø° ģģ¹ ģ ė³“(ģ¢ķ, ź³ ė, ģė, ź²½ė), ģģø ģ ė³“(Roll, Pitch, Yaw, AOA, AOS), ģ ģ“ ėŖ

ė ¹ ė° ė¬¼ė¦¬ ģ ė³“ ė± ģ“ 45ģ¢

ė„ģ ģģ ė°ģ“ķ°(raw data)ė„¼ ķėķģė¤. Fig. 10ź³¼ 11ģ ģģ§ė ģģ ė°ģ“ķ°ė„¼ ė°ķģ¼ė” ģøź° ģ”°ģ¢

ģ¬ģ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ ģ²“ ė¹ķź²½ė”ģ ģ ķ¬źø° ģģøģ ė³“(Roll, Pitch, Yaw)ė„¼ ė¶ģķ ź²°ź³¼ģ“ė¤. Fig. 10ģ ķµķ“ ģ ģ ģėÆģ“, ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģøź° ģ”°ģ¢

ģ¬ ėė¹ ė¶ķģķ źø°ėģ“ ģ ź³ ģµģ ģ ė¹ķź²½ė”ė„¼ ģ ķķź³ ģ“ė ź²°źµ ė ģ ģ ė¬¼ė¦¬ ģėģ§ė” ķØģØģ ģø ź³µģ¤ źµģ ģ ģķķģ¬ ģ ķ¬ė„¼ ģ¹ė¦¬ķė¤ź³ ķėØķ ģ ģė¤. ģ“ė° ź²°ź³¼ė Fig. 11ģ ģ ķ¬źø° ģģøģ ė³“ ė¶ģģģė ė³“ģ“ėė°, ģøź° ģ”°ģ¢

ģ¬ģ ģ ķ¬źø° ģģøė ģ¬ķź² ķė¤ė¦¬ė ė°ė©“, ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģøź° ģ”°ģ¢

ģ¬ ėė¹ ė¶ėė½ź³ ė³“ė¤ ģģ ģ ģø ģģø ė³ķė„¼ ė°ķģ¼ė” źµģ ģ ģķķė¤ė ź²ģ ķģøķ ģ ģģė¤. ģģ ė°ģ“ķ° ģģ§ģ ķµķ źµģ ź²°ź³¼ ė¶ģģ ķ„ķ ė³“ė¤ ė¤ģķź² ģ ģ©ė ģ ģė¤. ģģ§ė ė°ģ“ķ° ź°ģ ģź“ź“ź³ė ģøź³¼ź“ź³ ė±ģ ķµź³ģ ė¶ģģ ė°ķģ¼ė” ģė®¬ė ģ“ģ

ķź²½ź³¼ źµģ ėŖØėø ź²½ėķ ėæė§ ģėė¼ ģ”°ģ¢

ģ¬ ķė Øģ ģķ ė°±ģ

ė°ģ“ķ°ė”ė ķģ©ģ“ ź°ė„ķ ź²ģ¼ė” ķėØėė¤. ėķ, ģė Øė ė² ķ

ė ģ ķ¬ ģ”°ģ¢

ģ¬ģ źµģ ė°ģ“ķ°ė„¼ ķėķģ¬ źø°ź³ķģµ źø°ė°ģ AI ģ”°ģ¢

ģ¬ ź°ė°ģė ķģ© ź°ė„ķ ź²ģ¼ė” źø°ėķė¤.

ėÆøė ģ ģ„ģ ģ āė¬“ģø ķģ

ģ²“ź³ė„¼ ė°ķģ¼ė” ėŖØģģ“ķ¬ ģ ģ¼ė” ģ§ķėź³ ģė¤. ķ¹ķ, ģķėź° ėģ ź³µėź³µ ģė¬“ė„¼ ģķ AI ģ”°ģ¢

ģ¬ ź°ė°ģ ė§¤ģ° ģ¤ģķ ģ°źµ¬ ė¶ģ¼ģ“ė¤. ģ“ė„¼ ģķ“, ė³ø ė

¼ė¬øģģė ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøź³¼ ģ“ė„¼ ėŖØģķ ģ ģė ģė®¬ė ģ“ģ

ķź²½ģ ģ ģķģė¤. ģøź° ģ”°ģ¢

ģ¬ģģ źµģ ģ ķµķ“ ģ ģķ ź·ģ¹źø°ė° AI ź³µģ¤źµģ ėŖØėøģ ģ±ė„ģ ź²ģ¦ķģź³ źµģ ģķ ź³¼ģ ģ ź°ģģ ģ¼ė” ķģøķ ģ ģģģ ķģøķģė¤. ź·øė¦¬ź³ źµģ ģ¤ ģģ§ė ģģ ė°ģ“ķ°ė„¼ ė¶ģķģ¬ źµģ ź²°ź³¼ė„¼ ė³µźø°ķź³ ė ķØģØģ ģø ģ ķ¬ ģķģ ģķ ķė Ø ķź²½ģ ģ ź³µķ ģ ģģė¤. ėķ, ģ āė¬“ģø ķģ

ģ“ ź°ė„ķėė” ģė®¬ė ģ“ģ

ķź²½ģ źµ¬ģ±ķØģ¼ė”ģØ ė³ø ģ°źµ¬ ź²°ź³¼ź° ģ āė¬“ģø ė³µķ© ģė¬“ ź°ė

ģ ģ ė¦½ķź³ ķė Øķ ģ ģė źø°ģ“ź° ė ź²ģ¼ė” źø°ėķė¤. ģ“ė¬ķ ź²°ź³¼ė¤ģ ė°ķģ¼ė” ģ°ė¦¬ė ķ„ķ ė³“ė¤ ė¤ģķ AI ģź³ ė¦¬ģ¦ źø°ė°ģ ź³µģ¤źµģ ėŖØėø ź°ė°ź³¼ ģė¬“ ģ¬ķ ė¹, ź²½ė” ģ¬ķģ ė± UASė„¼ ģķ ģģØķ ģķķøģØģ“ģ ķģ¬ź° ź°ė„ķ ź²ģ¼ė” ķėØķė¤.

References

[1] Cheongyoung Kim, Jihyun Oh, Yong-Duk Kim, JungHo Bae, Monyeol Kim and SungHo Kim, A Design of a Rule-based AI Fighter Pilot and Virtual Engagement Model for Air Combat Simulation, SASE 2020, Fall Conference..

[2] Jihyun Oh, Cheonyoung Kim, Sunghwan Ro, Woochang Choi and Yong-duk Kim, Air-to-air BFM Engagement Simulator for AI Engagement Model, KIMST Annual Conference Proceedings. 2022.

[3] Byungho Jung, Seunghoon Yoo, Hogyun Hong, Jihyun Oh and Hyunju Seol, A Study on the Autonomous Function of Unmanned Aircraft for MUM-T, KSAS Fall Conference Proceedings. pp. 455ā456, 2021.

[4] S Jang, Study of Intelligent Pilot Model Based on Basic Fighter Maneuvering for Air Combat Simulation, Doctoral Dissertation, Department of AE, Inha Univ.2012.

[5] B. Clark, D. Patt and H. Schramm, "Mosaic Warfare Exploiting Artificial Intelligence and Autonomous Systems to Implement Decision-Centric Operations," CSBA, Feb, 2020.

[6] M. Gunzinger, C. Rehberg and L. Autenried, "Five Priorities for the Air Force's Future Combat Air Force," CSBA, 2020.

[7] D. Javorsek, Air Combat Evolution, DARPA/STO. May 2019.

[8] O. CordĆ³n, F. Herrera, F. Gomide, F. Hoffmann and L. Magdalena, "Ten Years of Genetic Fuzzy Systems: Current Framework and New Trends," In Proceedings Joint 9th IFSA World Congress and 20th NAFIPS International Conference(Cat. No. 01TH8569), Vol. 3, pp. 1241ā1246, IEEE. 2001, July.

[9] Jon Berndt, JSBSim: An Open Source Flight Dynamics Model in C++, AIAA Modeling and Simulation Technologies Conference and Exhibit. 2004.

[10] George H. Burgin, Lawrence J. Fogel and J. Price Phelps, An Adaptive Maneuvering Logic Computer Program for the Simulation of One-on-One Air-to- Air Combat, Volume 1: General Description, No. NASA-CR-2582, NASA. 1975.

[11] George H. Burgin and L. B. Sidor, Rule-based Air Combat Simulation, No. H-1501. 1988.

[12] Daniel Kahneman and Amos Tversky, The Simulation Heuristic, Stanford Univ CA Dept of Psychology. 1981.

[13] Earl Lazarus, "The Application of Value-Driven Decision-Making in Air Combat Simulation," 1997 IEEE International Conference on Systems, Man, and Cybernetics, Computational Cybernetics and Simulation, Vol. 3, IEEE. 1997.

[14] J. H. Holland, L. B. Booker, M. Colombetti, M. Dorigo, D. E. Goldberg, S. Forrest and S. W. Wilson, "What is a Learning Classifier System?," "International Workshop on Learning Classifier Systems," p. 3ā32, Springer, Berlin, Heidelberg, 1999, July.

[15] Kaelbling, Leslie Pack, Michael L. Littman and Andrew W. Moore, "Reinforcement Learning: A Survey," Journal of Artificial Intelligence Research, Vol. 4, pp. 237ā285, 1996.

[16] Sarthak R. Kukreti, Manish Kumar and Kelly Cohen, "Genetic Fuzzy based Target Geo- Localization Using Unmanned Aerial Systems for Firefighting Applications," 2018 AIAA Information Systems-AIAA Infotech@ Aerospace, Vol. 2136, 2018.

[17] Anoop Sathyan, Nicholas D. Ernest and Kelly Cohen, "An Efficient Genetic Fuzzy Approach to UAV Swarm Routing," Unmanned Systems, Vol. 4.02, pp. 117ā127, 2016.

[18] Anoop Sathyan, Kelly Cohen and Ou Ma, "Genetic Fuzzy based Scalable System of Distributed Robots for a Collaborative Task," Frontiers in Robotics and AI, Vol. 7, pp. 6012432020.

[19] N. Ernest, D. Carroll, C. Schumacher, M. Clark, K. Cohen and G. Lee, "Genetic Fuzzy based Artificial Intelligence for Unmanned Combat Aerial Vehicle Control in Simulated Air Combat Missions," Journal of Defense Management, Vol. 6, No. 1, pp. 2167ā0374, 2016.

[20] Xiaoteng Ma, Li Xia and Qianchuan Zhao, "Air-Combat Strategy Using Deep Q-Learning," 2018. CAC.

[21] Bogdan Vlahov, Eric Squires, Laura Strickland and Charles Pippin, On Developing a UAV Pursuit- Evation Policy Using Reinforcement Learning, 2018 17th ICMLA..

[22] Nicholas Ernest, Kelly Cohen, Elad Kivelevitch, Corey Schumacher and David Casbeer, "Genetic Fuzzy Trees and their Application Towards Autonomous Training and Control of a Squadron of Unmanned Combat Aerial Vehicles," Unmanned Systems, Vol. 3, No. 3, pp. 185ā204, 2015.

[23] S. Akabari, M. B. Mejhaj and S. K. Nikravesh, Fuzzy Modeling of Offensive Maneuvers in an Air-to-Air Combat, Proc. of the Computational Intelligence, Theory and Applications. pp. 171ā184, 2005.

[24] Nelson RamĆrez LĆ³pez and RafaÅ Å»bikowski, "Effectiveness of Autonomous Decision Making for Unmanned Combat Aerial Vehicles in Dogfight Engagements," Journal of Guidance, Control, and Dynamics, Vol. 41, No. 4, April 2018.

[25] Dong-Il You and Hyunchul Shim, "Design of an Autonomoous Air Combat Guidance Law using a Virtual Pursuit Point for UCAV," J. of The Korean Society for Aeronautical and Space Sciences, Vol. 42, No. 3, pp. 199ā212, 2014.

- TOOLS

-

METRICS

-

- 1 Crossref

- 2,209 View

- 84 Download

- Related articles in J. KIMS Technol.

-

Fuzzy Rule-Based Method for Air Threat Evaluation2016 February;19(1)

A Development of Instrumentation Radar Tracking Status Simulator2011 June;14(3)

A Study on the Development of Fuel Metering Unit for Air Breathing Engine2005 December;8(4)

The Development of a Telemetry System for ALQ-X2005 March;8(1)